SNSで陥るエコーチェンバー・フィルターバブル現象の違い・比較

指導員研修3時間です。

14時から頑張ります!

イーンスパイアの横田です。

https://www.enspire.co.jp

さて、本題です。

2017年頃より生まれた2つの言葉の意味と

エコーチェンバー・フィルターバブル現象の

比較とSNSでの陥らないための対策とは?

https://www.youtube.com/live/oX3L6KA1AH0

エコーチェンバーとフィルターバブルの

検索数の推移をGoogleトレンドで調べると?

https://trends.google.com/trends/explore?date=2011-06-24%202025-07-24&q=%E3%82%A8%E3%82%B3%E3%83%BC%E3%83%81%E3%82%A7%E3%83%B3%E3%83%90%E3%83%BC,%E3%83%95%E3%82%A3%E3%83%AB%E3%82%BF%E3%83%BC%E3%83%90%E3%83%96%E3%83%AB

SNSで陥るエコーチェンバー・フィルターバブル現象の違い・比較

能動的な選択

自分と同じ意見の人をフォロー

→ 似た意見ばかりが反響

確証バイアスが影響

自動的な選択

アルゴリズムが好みを学習

→ 類似情報を自動推薦

検索・SNSの仕組み

エコーチェンバー = 自分で作る情報の偏り

フィルターバブル = システムが作る情報の偏り

2017年 🎯 転換点

📱 TikTok誕生 – おすすめアルゴリズムの革命

📈 Googleトレンドで「エコーチェンバー」「フィルターバブル」急上昇

🔄 あなた好みの情報を自動配信する時代の幕開け

🇺🇸 アメリカ議会襲撃事件(2021年)

Qアノン陰謀論がSNSで拡散 → 現実社会で暴動に発展

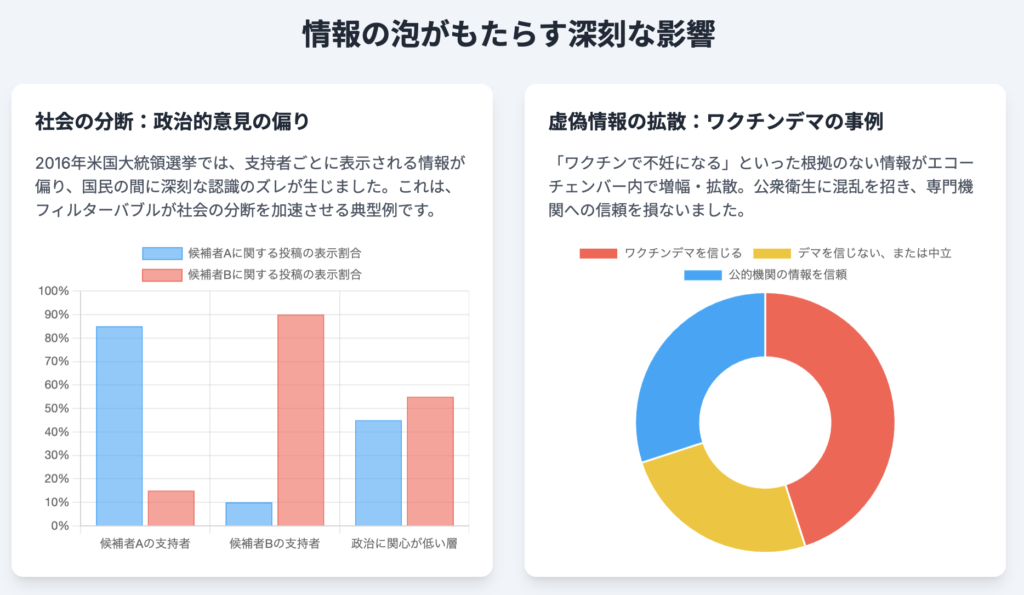

🇯🇵 コロナワクチンデマ拡散

「ワクチンで不妊」など根拠のない情報 → 社会的混乱

異なる意見への不寛容

デマが真実のように

政治的対立の激化

過去10年で3倍に

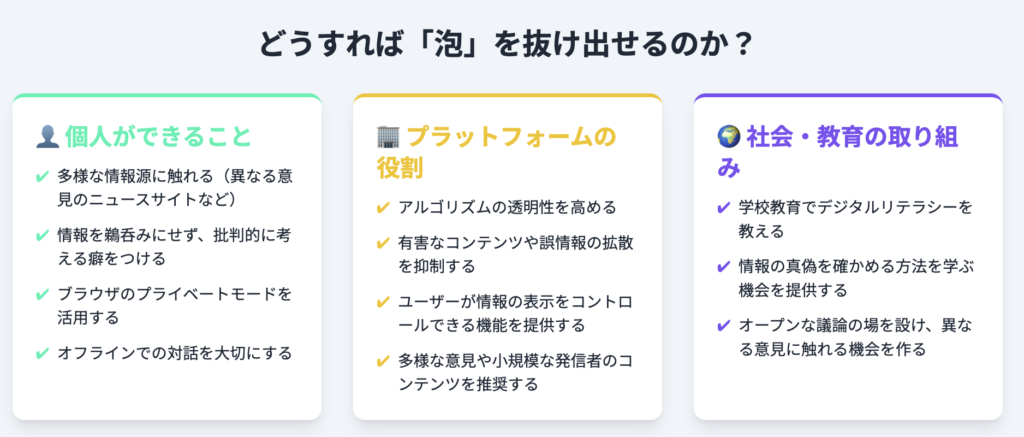

- 普段読まない異なる意見のニュースサイトを見る

- 批判的思考で「本当に正しいのか?」と疑う

- ブラウザのプライベートモードを活用

- SNSのレコメンド機能を調整(非表示・ブロック)

- オフラインでの多様な交流を大切にする

- アルゴリズムの透明性向上

- 有害コンテンツ・誤情報拡散の抑制

- ユーザーによる情報表示コントロール機能

- 多様な意見や小規模発信者の推奨

- 学校でのデジタルリテラシー教育

- 情報の真偽確認方法を学ぶ機会

- オープンな議論の場づくり

⚠️ ChatGPT等の生成AIの影響

💭 最大公約数的な答えが生成される

🔄 大多数の意見を信じる傾向がさらに強化

💡 対策:「この意見と反対の意見の両方を出してください」と両論併記で質問する

📚 情報は「見たいもの」だけでなく「見るべきもの」にも目を向ける

🤝 自分の意見は絶対ではない – 違う考えもあると思える社会へ

👥 それを作るのは私たち一人一人の意識から

SNSで陥るエコーチェンバー・フィルターバブル現象の違い・比較

SNS時代の情報偏向に関する解説。エコーチェンバー(自分と同じ意見ばかりが反響する現象)とフィルターバブル(アルゴリズムが好みに合わせて情報を選別する現象)について詳述。前者は能動的選択、後者は自動的選択による情報の偏りを指す。両現象が相互作用し、社会分断や誤情報拡散を招く危険性を警告。対策として多様な情報源への接触、批判的思考、デジタルリテラシー向上の重要性を強調している。

- はじめに

- エコーチェンバーとフィルターバブルとは何か?

- 実際に起こった深刻な事例から学ぶ

- 情報の偏りが社会に与える深刻な影響

- 情報の泡から抜け出すための具体的な対策

- おわりに

- よくある質問

はじめに

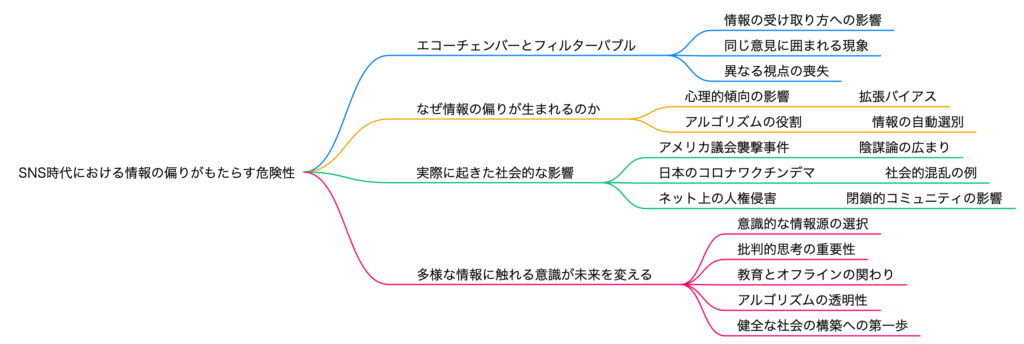

現代のSNS社会において、私たちは膨大な情報の海の中で生活しています。しかし、その便利さの裏側で、知らず知らずのうちに情報の偏りに巻き込まれているという現実をご存知でしょうか。「なんだか自分と同じ意見ばっかりが目に入る」「違う意見に出会う機会が減った」と感じたことがある方も多いのではないでしょうか。実は、これらは偶然ではなく、エコーチェンバーやフィルターバブルという現象によって引き起こされている可能性があります。今回は、この2つの概念について詳しく解説し、それらが私たちの思考や社会に与える影響、そして健全な情報社会を築くための対策について、AI技術を活用した最新の分析結果とともにお伝えします。

エコーチェンバーとフィルターバブルとは何か?

まず、この2つの重要な概念について詳しく見ていきましょう。

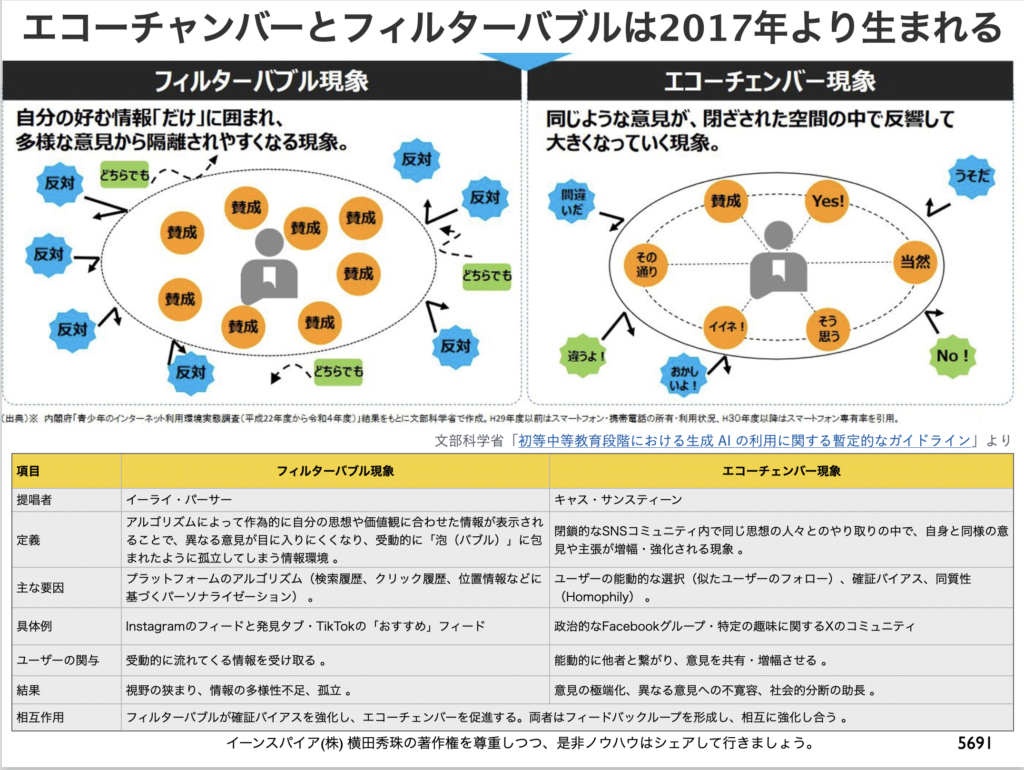

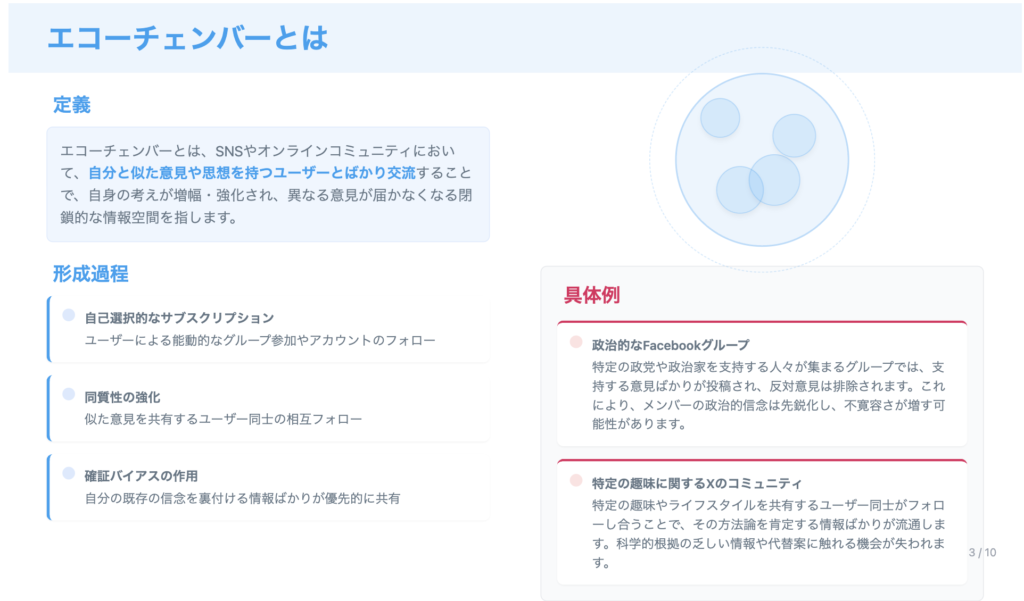

エコーチェンバーの定義と仕組み

エコーチェンバーとは、SNSで自分と同じ意見の人ばっかりをフォローしていると、似たような意見だけが繰り返し返ってくる現象のことです。まるで、こだま(エコー)のように自分の声が反響して戻ってくるようなイメージです。エコーは「自分の意見や自分の声」を意味し、チェンバーは「その場所や部屋」を表します。

この現象の背景には、「拡張バイアス」という心理的傾向があります。これは、自分の考えと一致する情報ばかりを選び、違う意見を無意識に避けてしまう人間の性質です。自己選択的なサブスクリプションや会員制のオンラインサロンに入る、特定の趣味に関するXのコミュニティに参加する、政治的なFacebookグループに入るなど、様々な場面で発生します。

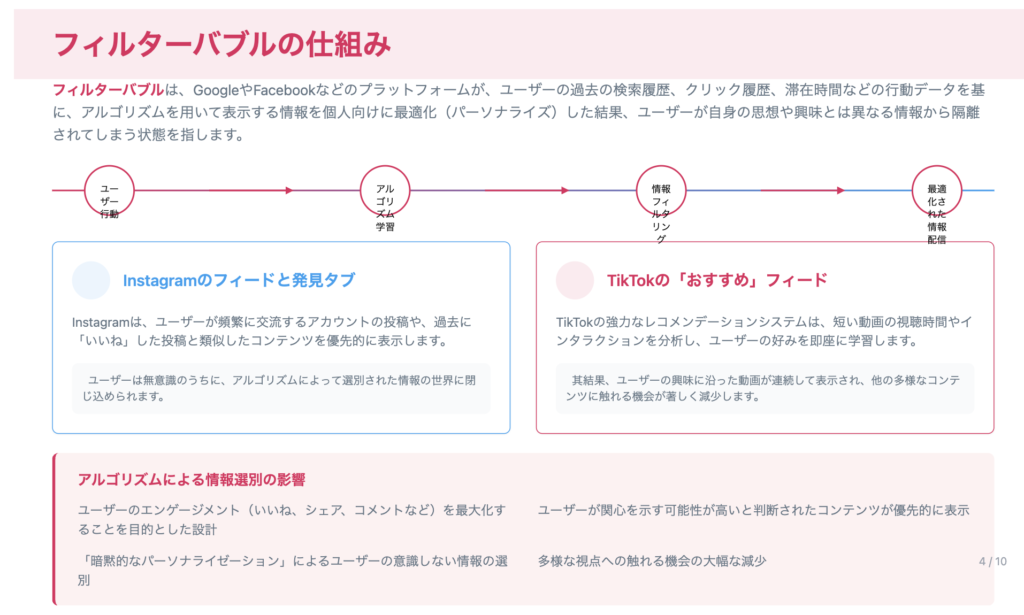

フィルターバブルの定義と仕組み

一方、フィルターバブルとは、アルゴリズムが勝手にあなたの好みに合わせて情報を見せてくれる状態のことを言います。検索履歴やクリック履歴、滞在時間などをもとに、SNSや検索エンジンが「これが好きでしょう」という情報を選んでくれます。便利なようでいて、実は自分と違う意見や価値観に触れる機会を奪ってしまっているのです。

プラットフォーム側のGoogleやFacebookなどが、ユーザーの過去の閲覧履歴、クリック履歴、滞在時間などの行動データを分析して実現しています。TikTokのおすすめフィード、Instagramの発見タブやフィードなども、同じような仕組みになっています。

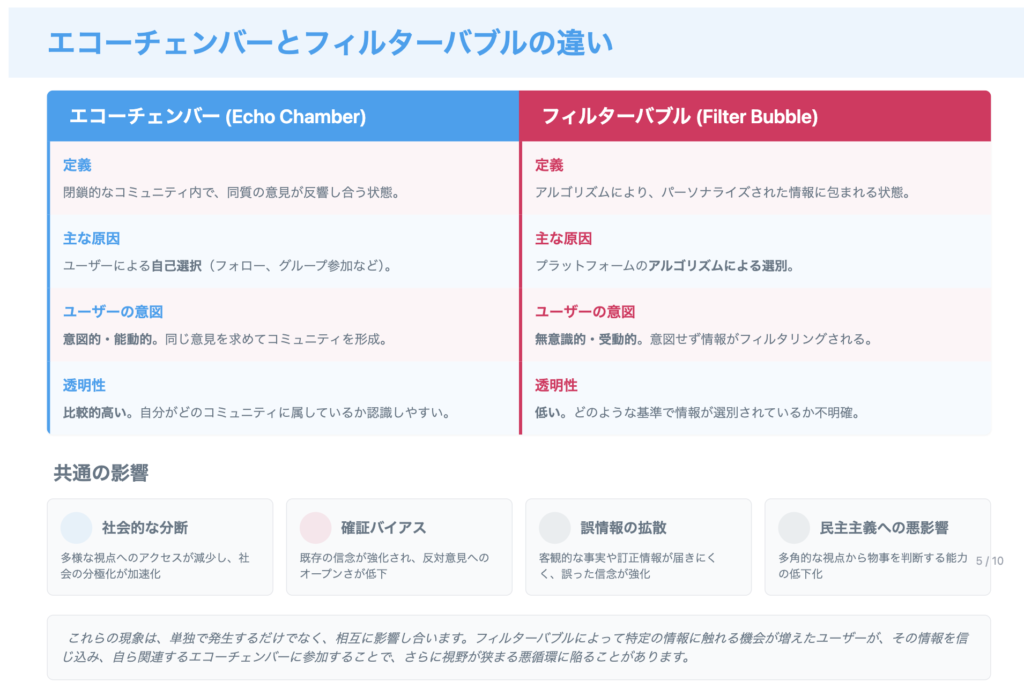

2つの概念の違いと関係性

興味深いことに、エコーチェンバーは「能動的な選択」によって起こり、フィルターバブルは「自動的な選択」によって起こります。エコーチェンバーは自分が何かの情報を選んでいく時に起きるのに対し、フィルターバブルはSNSなどのアルゴリズムによって結果的にそういう方向に行ってしまうものです。

この2つが複雑に絡み合いながら、SNSで増幅・拡散されていきます。最初のきっかけはエコーチェンバーで始まるけれど、フィルターバブルがかかることによって、さらにそれがまたエコーチェンバーになって、この2つがぐるぐる回りながらどんどんその片方に寄っていくという悪循環が生まれるのです。

歴史的背景と技術の発展

Googleトレンドでのキーワード検索数の推移を調べてみると面白いことがわかります。エコーチェンバーやフィルターバブルという言葉が出てきたのは2017年頃からです。2017年はTikTokが誕生した年でもあります。TikTokは新しいSNSの形として、「あなたはこんなのが好きなんでしょう?」ということをおすすめに出すアルゴリズムを本格的に導入しました。この頃から、自分好みのものがどんどん出てくる仕組みが急速に発達し、それに伴ってこれらの概念も生まれてきたと考えられます。

実際に起こった深刻な事例から学ぶ

理論だけでなく、実際に起こった事例を通して、これらの現象がいかに深刻な影響を与えるかを見ていきましょう。

アメリカ議会襲撃事件

2021年にアメリカの議会で起きた襲撃事件は、エコーチェンバーとフィルターバブルの危険性を象徴する事例として語られています。Qアノンという陰謀論がSNS上で広まり、現実社会で暴動に発展しました。同じ考えを持つ人同士がSNSで集まり、意見が極端に強化された結果だと分析されています。

この事件では、特定の政治的信念を持つ人々が、同じような考えを持つアカウントをフォローし、似たような情報ばかりを共有するコミュニティを形成していました。そして、プラットフォームのアルゴリズムが、彼らの行動履歴に基づいて、さらに過激な内容を推奨するようになったのです。

日本のコロナワクチンデマの拡散

日本国内でも深刻な事例があります。コロナワクチンで不妊になるという根拠のない情報がSNSで拡散され、社会的な混乱が生じました。これもエコーチェンバーによって同じ意見が繰り返され、多くの人が信じてしまった典型例です。

この場合、最初は少数の人が発信した誤情報が、同じような不安を抱く人々のコミュニティで共有され、繰り返し議論される中で、まるで事実であるかのように信じられるようになりました。さらに、SNSのアルゴリズムが、そうした内容に関心を示すユーザーに対して、類似の情報をさらに推奨することで、誤情報の影響範囲が拡大したのです。

その他の国際的な事例

世界各国で類似の現象が報告されています。政治的な対立の激化、宗教的な過激思想の拡散、健康に関する誤情報の蔓延など、様々な分野でエコーチェンバーとフィルターバブルの影響が確認されています。これらの事例は、単なる理論上の問題ではなく、現実社会に深刻な影響を与える現象であることを示しています。

情報の偏りが社会に与える深刻な影響

エコーチェンバーとフィルターバブルは、私たちの社会に様々な深刻な影響をもたらします。

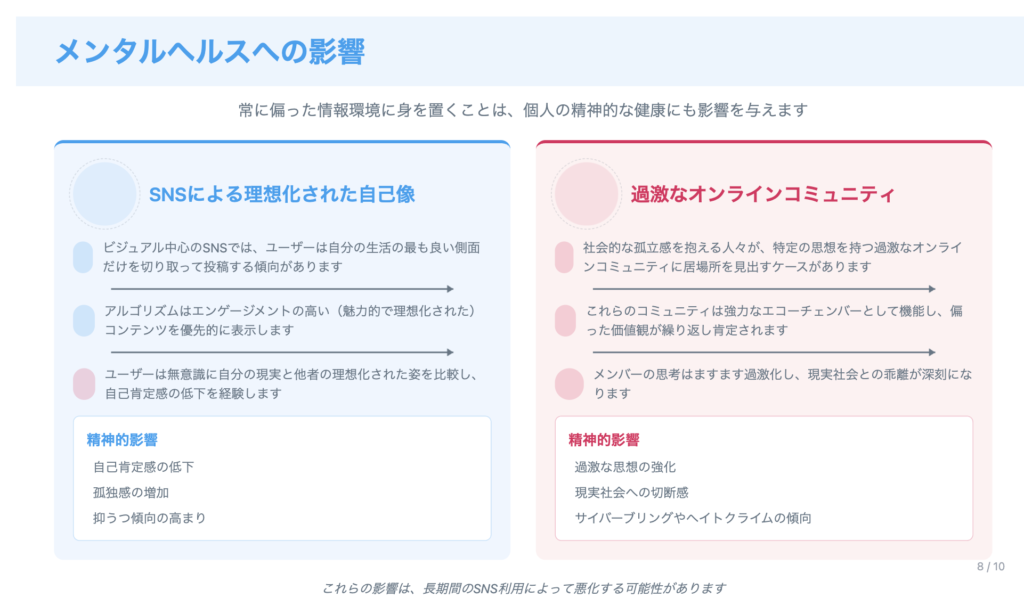

意見の極端化と不寛容の増大

まず第一に、意見がどんどん極端になっていくという問題があります。同じような考えを持つ人々の中にいると、より過激な意見が支持を得やすくなり、穏健な意見は軽視される傾向があります。その結果、異なる意見に対して不寛容になってしまうのです。

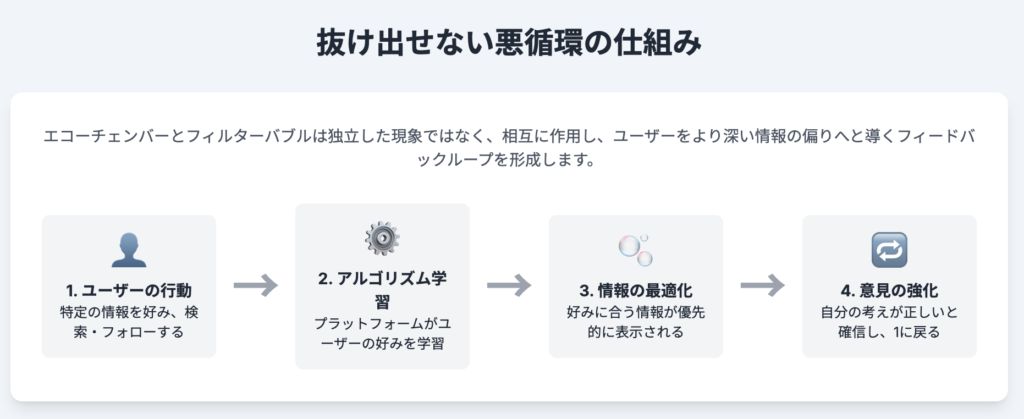

この悪循環の仕組みは以下のようになっています:

- ユーザーが特定の情報を好み、検索する

- アルゴリズムが学習し、プラットフォームがユーザーの好みを把握

- 好みに合う情報が優先的に表示される

- 意見が強化され、自分の考えが正しいと確信

- また1に戻り、さらにアルゴリズムが学習される

このサイクルが繰り返されることで、どんどん偏った情報環境に閉じ込められていくのです。

誤情報とデマの拡散

エコーチェンバーとフィルターバブルは、誤情報やデマが広まりやすくなる土壌を作ります。同じような考えを持つ人々の間では、情報の真偽を批判的に検証する機会が少なくなり、感情的に共感できる情報が真実として受け入れられやすくなるからです。

偏った情報による誤った意思決定

私たちは日々、様々な情報をもとに意思決定を行っています。しかし、偏った情報環境にいると、重要な判断を誤ってしまう可能性が高くなります。政治的な選択、健康に関する判断、投資や消費の決定など、人生に大きな影響を与える場面で、誤った情報に基づいた判断をしてしまうリスクがあるのです。

人権侵害とネットいじめの温床

特に深刻なのは、人権侵害やネットいじめの温床となってしまうことです。閉鎖的なコミュニティは過激な思想を育み、誹謗中傷やいじめの温床となります。実際、国内のネット上の人権侵害相談件数は過去10年で3倍に増加しており、エコーチェンバーがその一因である可能性が指摘されています。

社会の分断

これらの影響が積み重なることで、最終的には社会全体の分断につながります。政治的な意見の対立が激化し、異なる価値観を持つ人々の間での建設的な対話が困難になってしまうのです。SNS上の見えない壁が、現実社会の分断や混乱を引き起こしてしまうという深刻な問題が生じています。

生成AIによる新たな課題

さらに現在では、ChatGPTなどの生成AIが加わることで、新たな問題も浮上しています。生成AIが出す答えは、最大公約数的な、みんなが言っている意見が答えとして出てくる傾向があります。これにより、大多数の意見を無批判に信じていくという形になってしまう可能性があり、注意が必要です。

情報の泡から抜け出すための具体的な対策

これらの深刻な問題に対して、私たちはどのような対策を取ることができるでしょうか。個人、プラットフォーム、社会それぞれのレベルで考えてみましょう。

個人ができる対策

あえて違う意見にも目を向ける

普段は読まないニュースサイトを意識的に見る、異なる政治的立場のメディアをチェックする、自分とは異なる価値観を持つ人の意見に耳を傾けるなど、能動的に多様な情報源に触れることが重要です。

批判的思考を持つ

「本当に正しいのか」と疑ってみる癖をつけましょう。情報を鵜呑みにせず、批判的に考える習慣を身につけることで、誤情報に惑わされるリスクを減らすことができます。特に、感情的に訴えかける情報や、自分の既存の信念を強化する情報に対しては、より慎重な検証が必要です。

SNSのレコメンド機能を調整する

プラットフォームの設定を活用して、非表示にしたり、ブロック機能を適切に使ったりすることで、アルゴリズムによる情報の偏りを軽減することができます。TikTokなどでは定期的にリセットする機能も用意されているので、偏ったレコメンドを一度外すことも大切です。

ブラウザのプライベートモードを活用する

シークレットウィンドウやプライベートモードを使って情報を検索することで、過去の履歴に影響されない検索結果を得ることができます。また、日頃自分が見ているアカウントでない状態(ログインしない状態)で見る、日頃自分が見ていないアカウントでログインしてみるといったことも効果的です。

オフラインでの交流を大切にする

デジタル上だけでなく、現実世界での多様な人との関わりを持つことで、異なる視点や価値観に触れる機会を増やすことができます。

ChatGPTなどのAI利用時の工夫

AI技術を使用する際は、答えをすぐに求めるのではなく、「この意見と反対の意見の両方を出してください」という両論併記で答えを求めるような使い方をすることで、片方に偏ることを避けることができます。

プラットフォームの役割と取り組み

アルゴリズムの透明性を高める

プラットフォーム事業者は、どのような基準で情報が表示されているかをユーザーにわかりやすく説明する責任があります。アルゴリズムの動作原理を透明化することで、ユーザーが自分の情報環境をより良く理解し、適切に対処できるようになります。

有害なコンテンツや誤情報の拡散を抑制する

技術的な対策とコンテンツモデレーションの強化により、明らかに有害な情報や誤情報の拡散を防ぐ取り組みが必要です。

ユーザーが情報の表示をコントロールできる機能を提供

ユーザー自身が情報の表示方法を調整できる設定オプションを充実させることで、より多様な情報に触れる機会を提供することができます。

多様な意見や小規模な発信者のコンテンツを推奨する

大手メディアや人気アカウントの情報だけでなく、多様な背景を持つ発信者のコンテンツを積極的に推奨する仕組みが求められています。

社会・教育の取り組み

学校でデジタルリテラシーを教える

教育機関において、デジタル時代に必要な情報リテラシーを体系的に教育することが重要です。情報の真偽を確かめる方法、批判的思考の技法、メディアリテラシーなどを学ぶ機会を提供する必要があります。

オープンな議論の場を設ける

異なる意見を持つ人々が建設的に対話できる場を社会全体で作っていくことが重要です。大学、地域コミュニティ、企業など、様々な場面でこうした取り組みが求められています。

継続的な研究と対策の改善

エコーチェンバーとフィルターバブルの問題は、技術の発展とともに変化し続けています。継続的な研究と、それに基づいた対策の改善が必要です。

おわりに

エコーチェンバーとフィルターバブルは、現代のデジタル社会における重要な課題です。これらの現象は、私たちが気づかないうちに思考や行動を大きく左右し、個人の判断力を損なうだけでなく、社会全体の分断を引き起こす可能性があります。しかし、その仕組みを理解し、適切な対策を講じることで、これらの負の影響を軽減することは可能です。情報は見たいものだけではなく、見るべきものにも目を向けることが大切です。自分の意見は絶対ではなく、違う考えもあると思える社会を作るのは、私たち一人一人の意識からです。AI技術の発達により、情報の処理や分析がより高度になる一方で、人間の批判的思考や多様性への理解がますます重要になっています。今回紹介した対策を実践し、健全な情報社会の構築に向けて、共に取り組んでいきましょう。この情報があなたの情報との向き合い方を見直すきっかけになれば幸いです。

よくある質問

Q1: エコーチェンバーとフィルターバブルの違いが分からないのですが、簡単に説明してもらえますか?

A1: エコーチェンバーは「自分で選択して作り出す情報の偏り」で、フィルターバブルは「アルゴリズムによって自動的に作られる情報の偏り」です。エコーチェンバーは自分が同じ意見の人をフォローしたり、特定のコミュニティに参加したりすることで起こります。一方、フィルターバブルはSNSや検索エンジンのアルゴリズムが、あなたの過去の行動履歴をもとに「好みそうな情報」を自動的に表示することで起こります。両者は相互に影響し合い、情報の偏りを加速させる関係にあります。

Q2: 自分がエコーチェンバーやフィルターバブルに陥っているかどうか、どうやって判断すればいいですか?

A2: いくつかのサインがあります。SNSで自分と反対の意見をほとんど見かけない、同じようなニュースや情報ばかりが表示される、異なる意見を見ると強い拒否反応を感じる、自分の考えに疑問を持つことが少なくなった、などです。簡単な確認方法として、ログアウトした状態やプライベートモードで同じキーワードを検索し、普段と違う結果が出るかチェックしてみてください。また、異なる政治的立場のニュースサイトを意識的に見て、普段触れない情報があるかどうか確認するのも効果的です。

Q3: 完全にエコーチェンバーから抜け出すことは可能ですか?それとも、ある程度は仕方ないものなのでしょうか?

A3: 完全に抜け出すことは現実的ではありませんし、必要でもありません。人間には本来、自分と似たような価値観や興味を持つ人と関わりたいという自然な傾向があります。重要なのは、バランスを取ることです。自分の興味関心に基づいた情報収集を楽しみながらも、定期的に異なる視点の情報に触れる機会を意識的に作ることが大切です。週に一度は普段読まないメディアをチェックする、月に一回は異なる立場の人と対話する機会を設けるなど、無理のない範囲で多様性を取り入れることを心がけましょう。

Q4: 子どもや若い世代に対して、この問題をどのように教育すればよいでしょうか?

A4: 年齢に応じたアプローチが重要です。小学生には「いろいろな意見があることの大切さ」を遊びや体験を通じて教え、中学生には「情報の出どころを確認する習慣」を身につけさせ、高校生には「批判的思考」の技法を具体的に教えることが効果的です。実際のSNSの投稿を例に、「この情報は本当かな?」「他にはどんな見方があるかな?」と一緒に考える練習をすることも大切です。また、デジタルデトックスの時間を設けて、オフラインでの多様な体験や人との関わりを大切にすることで、バランスの取れた情報感覚を育てることができます。

Q5: 企業や組織として、従業員のエコーチェンバー問題にどう対処すればよいでしょうか?

A5: 組織レベルでの対策には複数のアプローチがあります。まず、社内研修でデジタルリテラシーとメディアリテラシーの教育を実施することが基本です。また、チーム構成や会議の進め方を工夫し、異なる背景や視点を持つメンバーが発言しやすい環境を作ることも重要です。情報収集においては、複数の情報源を参照することを社内ルール化し、重要な意思決定の際には必ず「反対意見」や「リスク」についても検討する時間を設けることを推奨します。さらに、社外の専門家や異業種の人々との交流機会を定期的に設けることで、組織全体の視野を広げることができます。

詳しくは15分の動画で解説しました。

https://www.youtube.com/watch?v=GH6S3InuXdo

0:00 👋 導入・挨拶とテーマ紹介

1:08 🤖 AIツールを活用した動画制作方法

2:15 📚 エコーチェンバーとフィルターバブルの基本概念

3:24 🔍 エコーチェンバーの詳細とGoogleトレンド分析

4:33 📰 実際の事例紹介(議会襲撃・ワクチン情報)

5:39 ⚠️ 社会への影響と対処法

6:47 🧠 生成AIの影響とインフォグラフィック

7:56 🔄 二つの現象の仕組みと相互作用

9:01 🌀 悪循環の構造と深刻な社会問題

10:07 🚪 情報の泡から抜け出す具体的方法

11:18 📊 スカイワークによるスライド解説

12:20 📱 TikTok等のアルゴリズムの具体例

13:22 👨🏫 提唱者の紹介と理論的背景

14:28 🖼️ 画像検索による視覚的理解とまとめ

上記の動画はYouTubeメンバーシップのみ

公開しています。詳しくは以下をご覧ください。

https://yokotashurin.com/youtube/membership.html

YouTubeメンバーシップ申込こちら↓

https://www.youtube.com/channel/UCXHCC1WbbF3jPnL1JdRWWNA/join

SNSで陥るエコーチェンバー・フィルターバブル現象の違い・比較

🔄 エコーチェンバー

自分と同じ意見の人ばかりをフォローすることで、似たような意見だけが繰り返し返ってくる現象。エコー(こだま)のように自分の声が反響して戻ってくるイメージから名付けられた。ユーザーが能動的に選択することで起こる情報の偏りで、確証バイアスという心理的傾向が背景にある。

🫧 フィルターバブル

検索履歴やクリック履歴をもとに、SNSや検索エンジンのアルゴリズムが自動的にユーザーの好みに合わせて情報を選別・表示する状態。便利に見えるが、実際は自分と異なる意見や価値観に触れる機会を奪ってしまう。イーライ・パリサー氏が提唱した概念で、受動的な情報選別による偏りを指す。

📱 SNS

ソーシャルネットワーキングサービスの略で、現代の情報流通における主要プラットフォーム。TikTok、Instagram、X(旧Twitter)、Facebookなどが代表例。アルゴリズムによるおすすめ機能により、ユーザーの関心に合わせたコンテンツを配信するが、それが情報の偏りを生む原因ともなっている。

🤖 アルゴリズム

SNSプラットフォームが使用する、ユーザーの行動履歴や嗜好を分析して最適化されたコンテンツを表示する仕組み。機械学習により継続的に改善されるが、結果的にユーザーを情報の泡(バブル)に閉じ込める効果を持つ。透明性の向上と多様性確保が課題となっている。

🧠 確証バイアス

自分の考えと一致する情報ばかりを選び、異なる意見を無意識に避けてしまう心理的傾向。エコーチェンバー現象の根本的な原因となる人間の認知的バイアス。この傾向により、人は自分の既存の信念を強化する情報を積極的に求め、反対意見を排除しがちになる。

⚖️ 情報の偏り

特定の視点や意見に偏った情報ばかりに接することで生じる認識の歪み。エコーチェンバーとフィルターバブルの相互作用により増幅され、社会分断や誤情報の拡散、極端な意見の形成につながる。客観的で多角的な情報収集の重要性が指摘されている現代社会の重要課題。

📚 デジタルリテラシー

デジタル技術を適切に理解し、批判的に活用する能力。情報の真偽を見極める力、多様な情報源にアクセスする技術、プライバシー保護の知識などを含む。エコーチェンバーやフィルターバブルから抜け出すために必要不可欠なスキルとして、学校教育での習得が求められている。

🤖 生成AI

ChatGPTやGeminiなどの人工知能技術。大量のデータから学習し、人間のような文章や回答を生成する。しかし、最大公約数的な意見を答えとして出す傾向があるため、多数派の意見に偏る可能性が指摘されている。批判的思考と組み合わせて活用することが重要。

🤔 批判的思考

情報を鵜呑みにせず、「本当に正しいのか」と疑問を持ち、多角的に検証する思考方法。情報の信頼性や根拠を確認し、異なる視点からも考察する能力。エコーチェンバーやフィルターバブルに陥らないために最も重要なスキルの一つとして位置づけられている。

🌈 多様性

異なる意見、価値観、文化背景を持つ人々や情報に触れること。エコーチェンバーとフィルターバブルから抜け出すための根本的解決策。意図的に異なる意見のニュースサイトを見る、オフラインで多様な人と関わる、両論併記で情報を求めるなど、積極的な行動が求められる。

超要約1分ショート動画こちら↓

https://www.youtube.com/shorts/sHw2sKvmTQk

フィルターバブルの曲を作りました。

https://www.youtube.com/watch?v=JhzTt21q530

エコチェンバーの曲を作りました。

https://www.youtube.com/watch?v=-0V37ILgkGY

SNSで陥るエコーチェンバー・フィルターバブル現象の違い・比較

SNSにおけるエコーチェンバー現象とフィルターバブル現象は、どちらも情報の偏りを生みやすい環境を指すが、その成り立ちには違いがある。エコーチェンバー現象とは、自分と同じ意見や価値観を持つ人々だけと交流することで、似た考えが繰り返し強調され、異なる意見が排除される状態を指す。これは主に自発的な行動、つまり「自分が選ぶフォローやグループ」によって生じる。一方、フィルターバブル現象は、SNSのアルゴリズムがユーザーの過去の行動をもとに関心のありそうな情報だけを表示することで、意図せずに特定の情報に偏る現象である。これは利用者の意思とは無関係に、自動的に構築される情報の偏りだ。つまり、エコーチェンバーは「人間関係」から、フィルターバブルは「システム設計」から生まれる。両者は異なる仕組みながら、情報の多様性を失わせるという共通のリスクを持っている。

はじめに:SNS時代の情報環境と本レポートの目的

現代社会において、ソーシャルネットワーキングサービス(SNS)は、情報収集やコミュニケーションの主要な手段として不可欠な存在となっています。その急速な普及と情報流通量の爆発的な増加は、利便性をもたらす一方で、新たな課題も生み出しています。インターネット上には「一生かかっても把握できないほどの多様な情報・意見・感想があふれている」にもかかわらず 、ユーザーは膨大な情報の中から自身が得る情報を選択する必要に迫られています 。

このような情報環境下で特に注目されるのが、「エコーチェンバー」と「フィルターバブル」と呼ばれる現象です。これらは、ユーザーが特定の情報や意見に囲まれ、異なる視点や意見に触れる機会が減少することで、考え方が偏ってしまう現象を指します 。この情報の偏りは、単に技術的な問題に留まらず、人間がもともと持つ傾向とネットメディアの特性が相互に作用することで発生すると考えられています 。特に、自分の考えを補強する情報を求めがちな「確証バイアス」といった人間の心理的傾向が、アルゴリズムによる情報のパーソナライゼーションと組み合わさることで、これらの現象が助長されることが指摘されています 。結果として、意見の極端化、虚偽情報の拡散、社会の分断、誤った意思決定など、個人から社会全体にわたる深刻な影響をもたらす可能性があります 。本レポートでは、これらの現象の定義、メカニズム、具体的な事例、そして個人、プラットフォーム、社会全体で取り組むべき対策を包括的に解説し、健全な情報環境構築への理解を深めることを目的とします。

第1章:エコーチェンバーとフィルターバブルの基礎理解

1.1 定義とメカニズム

エコーチェンバー現象:能動的な選択と意見の増幅

エコーチェンバー現象とは、ソーシャルメディアを利用する際、自分と似た興味関心を持つユーザーをフォローする結果、意見をSNSで発信すると自分と似た意見が返ってくるという状況を、閉じた小部屋で音が反響する様子に例えたものです 。この現象は、ユーザーが「自分の意思で他者と繋がる」ことで発生し、似た価値観の者同士でフォローし合い、同じ情報や意見ばかりが耳に入ってくるようになることを指します 。

このメカニズムの背景には、人間が「自分の考え方を補強するような情報や意見を求めがち」であるという「確証バイアス」が大きく影響しています 。ユーザーは無意識のうちに自分の信念を裏付ける情報を選択的に探し、異なる意見を排除する傾向があります。これにより、自身の意見が増幅・強化され、他人や異なる意見に耳を傾けなくなる傾向が懸念されます 。

フィルターバブル:アルゴリズムによる情報の選別と孤立

フィルターバブルとは、インターネットサービスがアルゴリズムを用いて、個々のユーザーの検索履歴やクリック履歴を分析し学習することで、ユーザーにとって望むと望まざるとにかかわらず見たい情報が優先的に表示され、利用者の観点に合わない情報からは隔離され、自身の考え方や価値観の「バブル(泡)」の中に孤立するという情報環境を指します 。これは、私たちが「能動的に選択することなく、受動的なパーソナライゼーション機能に基づいて生み出される」現象であり 、ユーザーは「情報の泡」に包まれている状態と表現されます 。

エコーチェンバー現象がユーザーの能動的な選択によって形成されるのに対し、フィルターバブルはアルゴリズムによる受動的な情報の選別が主な要因です。しかし、この能動的な関与と受動的な情報の受け取りという区別は、現実のSNS環境においては複雑に絡み合っています。アルゴリズムによる受動的な情報のフィルタリングが、ユーザーが能動的に同様の意見を求める行動を誘発し、さらにその能動的な行動がアルゴリズムを学習させ、より強力なフィルタリングへと繋がるという強力なフィードバックループが形成されます。この自己強化的なサイクルにより、現象は単独で発生するよりも一層深刻な影響をもたらす可能性があります。

1.2 両者の違いと相互作用

エコーチェンバーは、利用者が自ら心地よい情報環境を作り出そうとした結果作られた空間であるのに対し、フィルターバブルはシステムによって作られた空間であるという違いがあります 。エコーチェンバー現象が自らの意思によって人とつながるのに対して、フィルターバブルは流れてくる情報を目にするだけで、他人との関係はありません 。

しかし、両者は相互に影響し合い、プラットフォームのアルゴリズムとユーザーの行動(選択的接触)が組み合わさることで強化されるフィードバックループを形成しています 。フィルターバブルによって偏った情報に触れることで確証バイアスが強化され、エコーチェンバー現象に陥りやすくなるという関係性も指摘されています 。

学術界においても、フィルターバブル、エコーチェンバー、さらには「ラビットホール」といった概念の定義は研究論文ごとに異なっているのが現状です 。この定義の多様性は、これらの現象がデジタル環境においていかに複雑に絡み合い、明確に分離することが難しいかを示唆しています。厳密な区別よりも、それらが相互に作用し、相乗効果を生み出すメカニズムを理解することが重要です。これは、効果的な対策を講じる上でも大きな課題となり、ユーザーが自身の情報バイアスの源を認識することを困難にしている側面もあります。

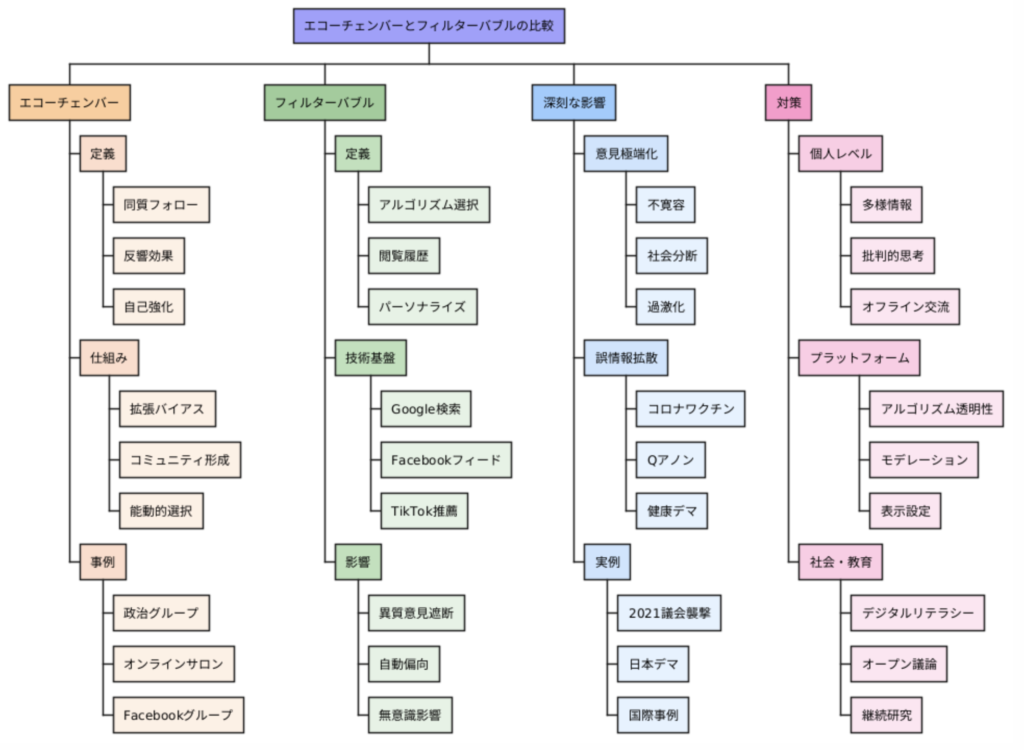

Table 1: エコーチェンバーとフィルターバブルの比較 以下の表は、エコーチェンバーとフィルターバブルの主要な違いと共通点をまとめたものです。

| 項目 | エコーチェンバー現象 | フィルターバブル |

| 定義 | 閉鎖的なSNSコミュニティ内で同じ思想の人々とのやり取りの中で、自身と同様の意見や主張が増幅・強化される現象 。 | アルゴリズムによって作為的に自分の思想や価値観に合わせた情報が表示されることで、異なる意見が目に入りにくくなり、受動的に「泡(バブル)」に包まれたように孤立してしまう情報環境 。 |

| 主な要因 | ユーザーの能動的な選択(似たユーザーのフォロー)、確証バイアス、同質性(Homophily) 。 | プラットフォームのアルゴリズム(検索履歴、クリック履歴、位置情報などに基づくパーソナライゼーション) 。 |

| ユーザーの関与 | 能動的に他者と繋がり、意見を共有・増幅させる 。 | 受動的に流れてくる情報を受け取る 。 |

| 結果 | 意見の極端化、異なる意見への不寛容、社会的分断の助長 。 | 視野の狭まり、情報の多様性不足、孤立 。 |

| 相互作用 | フィルターバブルが確証バイアスを強化し、エコーチェンバーを促進する。両者はフィードバックループを形成し、相互に強化し合う 。 | |

| 提唱者 | キャス・サンスティーン | イーライ・パーサー |

第2章:SNSにおけるエコーチェンバー・フィルターバブルの具体的事例

2.1 政治・社会問題における影響

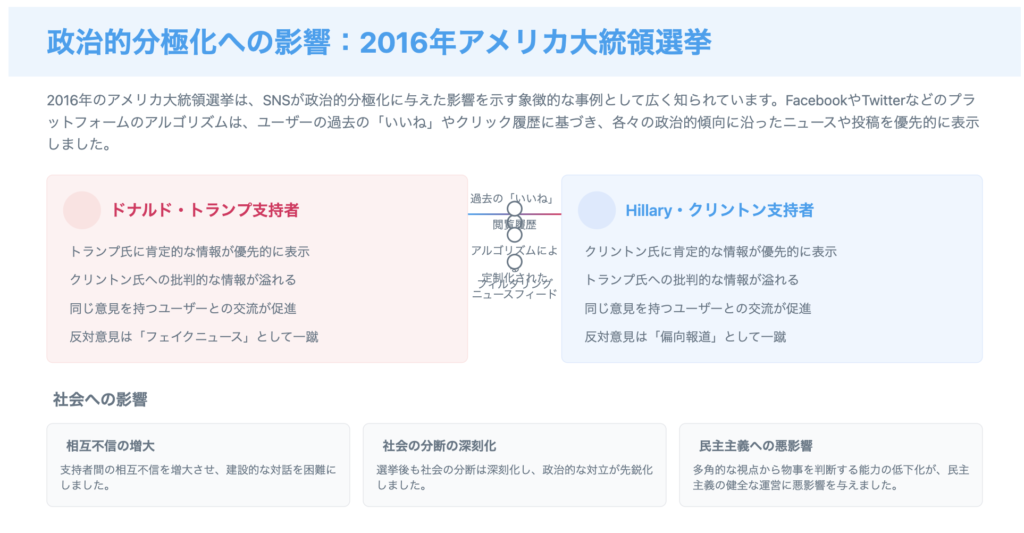

米国大統領選挙と議事堂襲撃事件

エコーチェンバーとフィルターバブルは、特に政治的な文脈においてその危険性が顕著に現れています。2016年のアメリカ大統領選挙期間中、Facebookのタイムラインでは、トランプ氏の支持者にはトランプ氏に関する投稿ばかり、クリントン氏の支持者にはクリントン氏に関する投稿ばかりが表示され、国民が自分の支持する党をすべての人が応援しているという錯覚を起こしていました 。

さらに深刻な事例として、2021年1月6日に発生した米国連邦議会議事堂襲撃事件が挙げられます。この事件の背景には、「Qアノン」などの陰謀論が大きく影響していたとされています 。SNSやインターネットを通じて拡散された陰謀論的な考えが、現実世界での過激な行動に結びついた結果、議会乱入という事態を引き起こしました。この事件により、SNS上で同じ考えを持つ人々が集まり、偏った情報や意見が強化されていく「エコチェンバー」や「フィルターバブル」の危険性が改めて認識されることとなりました 。これらの政治的な事例は、デジタル空間における現象が、現実世界における暴力的で社会的な混乱に直接つながる可能性を示しています。情報の「泡」の効果は、単なる受動的な情報消費に留まらず、歪んだ現実認識を共有し、集団行動を形成し、民主主義的なプロセスを損なう力を持つことが明らかになりました。

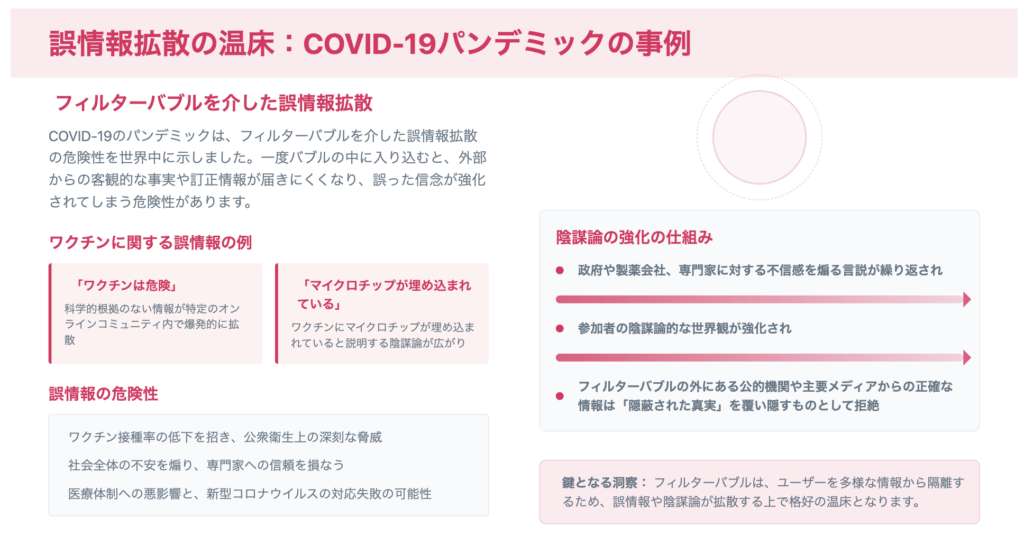

新型コロナウイルスに関するフェイクニュース(日本事例)

日本においても、エコーチェンバー現象が社会的分断を招いた具体例が存在します。新型コロナウイルス感染拡大期には、多くの不確かな情報がSNS上に流れ、社会が混乱しました。例えば、2021年には「コロナワクチンを打つと不妊になる」という根拠のない情報が広まり、これを受けて医師や公的機関が「ワクチン接種で不妊になるのは誤った情報である」と情報発信を行いました 。

この出来事の原因はエコーチェンバー現象であるとされており、同じ意見を持つ者同士で投稿をシェアし、その意見ばかりに触れた結果、不確定な情報を信じ込み、社会的分断を生み出してしまいました 。この新型コロナウイルスに関する事例は、これらの現象が公衆衛生や社会の結束に与える重大なリスクを浮き彫りにしました。誤情報がエコーチェンバーによって増幅されることで、効果的な危機対応が阻害され、科学的機関や政府機関に対する国民の信頼が損なわれ、最終的には社会全体の幸福が危険にさらされる可能性が示されました。

陰謀論の拡散と社会的分断

エコーチェンバーやフィルターバブルは、虚偽情報や陰謀論の拡散を加速させ、社会の不安定化を招く危険性があります 。国際大GLOCOMの研究チームによる調査では、政治的主張が強い人ほどデマを信じやすい傾向が明らかになっており、この傾向は保守層とリベラル層の両方に見られ、特に相手方を批判する内容を信じやすいことが分かっています 。専門家は、SNS利用により「確証バイアス」が強まり、自分の意見や願望に合致する情報を集めやすくなる一方で、異なる意見への攻撃性が高まる可能性を指摘しています 。SNS上ではデマや陰謀論が事実よりも拡散されやすいことも判明しており 、これが社会の分断を加速させます 。

政治的見解、確証バイアス、そして誤情報への感受性との間の強い関連性は、エコーチェンバーとフィルターバブルが単に既存の信念を強化するだけでなく、個人や集団を積極的に過激化させる可能性を強く示唆しています。このプロセスは、単なる意見の相違を露骨な敵意と社会の断片化へと変容させ、建設的な対話や妥協を民主主義社会においてますます困難にしています。

2.2 日常生活・個人への影響

情報収集の偏りと視野の狭まり

エコーチェンバーやフィルターバブルの影響は、政治や社会問題に限らず、個人の日常生活における情報収集にも及びます。例えば、猫好きの人が猫の動画や記事ばかり閲覧していると、アルゴリズムによって猫関連の情報しか表示されなくなり、他の動物や社会問題などの情報に触れる機会が減ってしまいます 。同様に、Google検索結果はユーザー個別の検索履歴に基づきカスタマイズされ、異なる情報に触れる機会が減少します 。X(旧Twitter)のおすすめフィードも、ユーザーの「いいね」やシェアに基づきカスタマイズされ、ユーザーは同じ意見の投稿ばかりを見るようになる傾向があります 。これにより、ユーザーは自分の興味や好みに合った情報を効率よく取得できる一方で、異なる意見や情報に触れる機会が減少し、結果として自分が信じている意見や価値観が強化され、他者の視点や異なる情報に対して開かれた態度を持ちにくくなります 。

猫の動画に関するパーソナライズされたコンテンツのように、一見無害に見える日常的な情報の偏りも、何百万人ものユーザーに集約されると、現実の集合的な理解を根本的に変えてしまいます。これにより、個人が共有された社会的な課題を把握したり、情報に基づいた市民的議論に参加したりすることがより困難になります。なぜなら、個々の「現実」が乖離していくためです。

消費行動への影響

エコーチェンバーとフィルターバブルの影響は、消費行動にも及びます。個人のデータに基づく操作的なマーケティングが進化し、消費者の自律性が脅かされる可能性があります 。

政治的・社会的な影響に加えて、フィルターバブルの商業的応用、すなわちパーソナライズされたマーケティングは、個人の自律性と批判的な消費者行動に対して、微妙ではあるものの重大な脅威をもたらします。これは、ユーザーが代替品や、フィルターによって排除される可能性のある批判的なレビューに触れることなく、特定の製品やサービスへと誘導されることで、情報に基づかない経済的決定を下す可能性を高め、選択肢を狭めることにつながりかねません。

第3章:エコーチェンバー・フィルターバブルがもたらす深刻な影響と潜在的リスク

3.1 意見の極端化と社会の分断

エコーチェンバーやフィルターバブルは、特定の意見や考えを強化し、極端な意見が生まれやすくなる環境を作り出します 。これにより、人々が異なる意見や考えに対して寛容さを失う可能性があり、社会の分断が加速する恐れがあります 。特に、このバブルの内側では、自身と似た考え・意見が多く集まり、反対のものは排除されるため、対立する意見を比較する機会が失われ、社会的弱者の声が反映されにくく、強者の意見が反映されやすくなる傾向があります 。

単なる「意見の強化」から「不寛容」そして「社会の分断」へと進行することは、民主主義的な議論の根本的な劣化を示唆しています 。異なる視点と関わり、それを尊重する能力が体系的に侵食されることで、社会はより脆弱で、より二極化し、潜在的には統治が困難な状態へと向かいます。

3.2 虚偽情報・陰謀論の拡散と信頼性の低下

自分に合った情報ばかりが表示されることで、誤情報やデマが拡散しやすくなる危険性があります 。特定のコミュニティ内でのみ共有される情報がフィルタリングされてしまい、客観的な視点や事実確認が行われにくくなるためです 。結果として、虚偽情報や陰謀論が事実よりも拡散しやすくなり 、社会の不安定化を招くことになります 。

これらの情報の泡の中で誤情報が容易に拡散することは 、真実と共有された現実に対するシステム的な課題を生み出します。これは、伝統的な情報源、科学機関、さらには政府に対する信頼の崩壊につながり、機能的で結束力のある社会の基本的な前提条件を揺るがします。

3.3 誤った意思決定と行動への影響

エコーチェンバーやフィルターバブルに陥ると、誤った“意思決定”や“行動選択”をしてしまう危険性があります 。たとえ自分の意見が世間の常識や事実からかけ離れていても、「自分の意見は正しい」という思い込みにつながりやすいためです 。この思い込みは思考を極端にさせ、自身の主張や賛同する意見や情報であれば、精査することなく誤った情報であってもシェア・拡散してしまう可能性を高めます 。米国議会議事堂襲撃事件 や日本の新型コロナウイルスに関するフェイクニュースの拡散 などは、この影響が現実世界で過激な行動や社会的分断に結びついた具体的な事例です。

情報の泡の中で「正しさ」が強化されることは 、自身の(潜在的に欠陥のある)判断に対する危険な過信につながる可能性があります。これにより、個人的に有害であるだけでなく、米国議会議事堂襲撃事件のような出来事によって鮮明に示されるように 、社会的に深刻な悪影響をもたらす行動が引き起こされます。個人が、絶え間ない、異論のない補強によって自身の意見が絶対的に正しいと確信すると、彼らは理性や外部の事実、あるいは異なる視点を受け入れにくくなります。この硬直性と確信の増大は、危険な誤情報の拡散、嫌がらせへの関与、あるいは市民の騒乱への参加といった極端な行動へと彼らを駆り立て、公共の秩序と安全に直接的な脅威をもたらすことになります。

3.4 人権侵害やいじめへの発展

エコーチェンバー現象は、特に閉鎖的なグループ内で、限られたメンバーが自分と同じような考えに触れるうちに過激な行動を起こしやすくなる危険性をはらんでいます。SNSでつながったグループにより、いじめが発生することは大きな問題として認識されています 。さらに、インターネット上での誹謗中傷は深刻化しており、いじめから失職、さらには自殺に至る事例も報告されています。国内ではネット上の人権侵害事件が過去10年で3倍に増加しているという統計もあり、エコーチェンバーがこうした人権侵害を助長する温床となり得る可能性が指摘されています 。

エコーチェンバーの閉鎖的な性質、特に子どもたちのような脆弱なグループ間では 、有害な集団思考が直接的な人権侵害へとエスカレートする環境へと変貌する可能性があります。これは、その影響が抽象的な「社会的分断」を超えて、具体的で深刻な現実世界の危害へと及ぶことを示しており、オンラインの社会的力学における警戒の必要性を強調しています。

Table 2: エコーチェンバー・フィルターバブルの主な影響と事例 以下の表は、エコーチェンバーとフィルターバブルがもたらす主な影響と、それに関連する具体的な事例をまとめたものです。

| 影響の種類 | 具体的な影響 | 代表的な事例 | 関連Snippet ID |

| 政治的極性化 | 意見の極端化、政治的主張の過激化、相手方への攻撃性増加 | 2016年米国大統領選挙、政治的主張が強い人ほどデマ受容リスク増の調査 | |

| 虚偽情報・陰謀論の拡散 | デマや陰謀論の蔓延、客観的事実の軽視、社会の不安定化 | 2021年米国議会議事堂襲撃事件(Qアノン陰謀論)、新型コロナウイルスに関するフェイクニュース | |

| 社会的分断 | 相互理解の阻害、異なる意見への不寛容、公的議論の質の低下 | 新型コロナウイルスに関するフェイクニュースによる社会的分断、集団極性化 | |

| 個人への心理的影響 | 視野の狭まり、誤った意思決定、過激な行動、自己肯定感の過剰な強化 | 猫好きの人が猫情報ばかりに触れる、自身の意見が正しいと思い込む | |

| 人権侵害・いじめ | 誹謗中傷の深刻化、いじめの発生、失職や自殺への発展 | SNSでのいじめ、ネット上の人権侵害事件の増加、弁護士懲戒請求事件 |

第4章:健全な情報環境を構築するための対策

4.1 個人でできる対策:メディアリテラシーの向上

多様な情報源の利用と批判的思考

エコーチェンバーやフィルターバブルから抜け出すためには、意識的に多様な情報源を利用することが極めて重要です 。普段読まないニュースサイトや雑誌を読んでみたり、異なる意見を持つ人たちと積極的に話してみたりすることが効果的です 。また、得られた情報をそのまま受け入れるのではなく、「これは本当に正しい情報か?」「別の視点からも考えられるだろうか?」といった疑問を持つ「批判的思考(クリティカルシンキング)」を日常的に心がけることが不可欠です 。これにより、情報の真偽を見極め、偏った情報に流されずに自分の判断力を高めることができます 。

「批判的思考」と「多様な情報源」を個人の対策として強調することは 、受動的な情報消費から能動的で識別力のある関与へと責任が根本的に移行していることを示しています。これは、メディアリテラシーがもはや専門的なスキルではなく、デジタル時代を適切に航海し、責任を持って参加するために必要な基本的な市民的能力であることを意味します。個人は、自身の情報環境のデフォルト設定に積極的に異議を唱え、情報を独立して評価するための認識ツールを育成し、それによって情報バイアスの潜在的な犠牲者から、回復力のある情報に通じた市民へと変革することが求められます。

自身の情報接触の客観視と確証バイアスの認識

エコーチェンバー現象に陥っていないかを定期的に自己評価し、「自分の見解が唯一の正解ではない」ことを認識することが重要です 。世間には自分と違う意見や思想を持った人がたくさんいることを認識し、あえて自分とは違う意見や思想を持つ人の発信を見て、多様な考え方・主張に触れておくことも必要です 。自分の考えや思考が偏っているかもしれないと「疑うこと」が、誤った思い込みを防ぐ第一歩となります 。

自己反省と自身のバイアスを認識するよう求めることは 、単なる技術的または外部的な解決策を超えたものです。これは、エコーチェンバーを克服するには、個人の考え方における深い変化、すなわち自身の認知バイアスに対するメタ認知的な認識が必要であることを示唆しています。これは、より困難ですが、デジタル時代において知的謙虚さと寛容さを育むための、より根本的な解決策であると言えるでしょう。

ブラウザ設定やSNS機能の活用

技術的な側面から、個人でフィルターバブルを回避するための対策も存在します。ブラウザの「プライベートモード(シークレットモード)」を利用して閲覧履歴が保存されないようにすることで、個人の興味や関心に偏った情報が表示されにくくなります 。また、Googleアカウントからログアウトしたり、広告のカスタマイズをオフにしたりすることも有効です 。SNS上のレコメンド機能を無効化する設定も活用できます。例えば、Facebookのフィードでは「さらに表示」や「表示を減らす」で変更でき、X(旧Twitter)では「このポストに興味がない」や「表示するコンテンツ」から変更が可能です 。YouTubeにおいては、「検索して見たいものだけ視聴OK」というルールを設定し、「ただ見る」から「意図的に情報を得る」視聴を心がけることが推奨されています 。

4.2 プラットフォーム側の取り組みと課題

アルゴリズムの透明性向上と誤情報対策

SNSプラットフォーム側も、エコーチェンバーやフィルターバブルの問題に対処するための取り組みを進めています。Meta(Facebookの運営会社)は、社会問題、選挙または政治に関連する広告のターゲティングに関する詳細な情報を学術研究者向けに公開し、アルゴリズムの透明性向上に努めています 。X(旧Twitter)のアルゴリズムは、ネガティブなフィードバックが多い投稿をフィルタリングしたり、一人のユーザーによる投稿が多すぎないよう調整したり、フォロー・フォロー外のバランスが取れるよう調整するなど、情報表示の偏りを軽減する工夫を凝らしています 。また、Xの経営者は「より情報的で楽しいもの」にするため、ネガティブ情報を減らす意向を表明しています 。YouTubeも、ポリシーに抵触しそうなコンテンツの広まりを抑制する「REDUCE」ポリシーを導入し、おすすめ動画からのこの種のコンテンツへの視聴回数を50%減少させることに成功しました 。さらに、小規模チャンネルの動画が表示されやすくなる「Hype」機能(日本はまだ未導入)の導入も進められており、多様なコンテンツへのアクセスを促進しようとする動きが見られます 。

プラットフォームは透明性ツール やコンテンツ削減ポリシー など様々な対策を実施していますが、エンゲージメント駆動型アルゴリズムの固有の設計 は根本的な緊張関係を生み出しています。彼らのビジネスモデルは、エコーチェンバーにつながる行動を奨励することが多く、これらの現象を真に緩和するためには、自主規制を超えたより深い構造的変化や規制上の監視が必要である可能性を示唆しています。

研究動向と今後の展望

フィルターバブルに関する学術的な研究は近年増加傾向にあり、様々な方法論とデータセットを通じて、レコメンド・システムにおけるフィルターバブルの存在が実証されています 。しかし、ほぼ全ての研究論文が異なる定義を使用している現状があり、定量化には「何が関与しているか」「何が示されているか」「何が考えられているか」という3つの変数間のフィードバックループに焦点を当てることが必要とされています 。また、既存のプラットフォーム等からのデータセットだけではユーザーの意思決定プロセスを完全に再構築することは困難であり、パネル調査とプラットフォームのデータを組み合わせる必要性が指摘されています 。一方で、YouTubeのシミュレーション型検証では、情報の偏りが一時的に緩和される傾向が見られ、プラットフォーム側でフィルターバブルを抑制する意図的な制御を行っている可能性が示唆されました 。今後の研究では、長期的な影響として、潜在的な視聴者の分断が時間の経過とともに増加するかどうかを検討する必要があるともされています 。

学術的な議論と研究課題の継続は 、これらの現象の根深い複雑さを浮き彫りにしており、普遍的に適用可能な決定的な解決策が依然として見つかっていないことを示しています。しかし、プラットフォームのアルゴリズムが意図的にバブルを緩和しようとしている可能性が示唆されていることは 、プラットフォームの責任において、単なるコンテンツモデレーションを超えて、社会全体の幸福のための積極的なアルゴリズム設計へと、新たな、しかし潜在的に重要な転換が起きていることを示唆しています。

4.3 教育と社会全体の役割

デジタルリテラシー教育の重要性

エコーチェンバーやフィルターバブルの問題に対処するためには、個人が情報化社会を適切に生き抜くための「メディアリテラシー」の向上が不可欠であり、その重要性が高まり、教育の変化が必要とされています 。教育現場では、生徒が特定の情報に偏らないように複数の情報源や異なる視点を提示すること、情報の真偽を確かめる方法や情報がどのように形成されているのかを理解させる「批判的思考力」を養うこと、そして生徒が異なる意見に触れ、自分の考えを他者と比較しながら深めていく機会を提供するために「オープンなディスカッションの場」を設けることが重要であるとされています 。

オフラインでの交流の促進

オンラインでの情報の偏りを是正するためには、現実世界での対話や交流も有効な手段です 。異なる見解や価値観を持つ人々との直接的な対話を通じて、多様な情報に触れる機会を増やすことができます 。オフラインでの交流は、オンラインの閉鎖的な情報環境から脱却し、バランスの取れた視点を持つために不可欠な要素となります 。

結論

SNSが現代社会の情報流通において不可欠な存在となる中で、エコーチェンバーとフィルターバブルは、個人から社会全体に至るまで多岐にわたる深刻な影響をもたらす現象として認識されています。エコーチェンバーはユーザーの能動的な選択と確証バイアスによって、フィルターバブルはアルゴリズムによる情報の選別によってそれぞれ形成されますが、これらは相互に作用し、自己強化的なフィードバックループを形成することで、その影響力を増幅させています。

これらの現象は、政治的極性化、虚偽情報や陰謀論の拡散、社会的分断といった社会全体を揺るがす問題から、個人の視野の狭まり、誤った意思決定、さらには人権侵害やいじめといった具体的な危害に至るまで、広範な弊害を引き起こすことが具体的な事例によって示されています。特に、情報の泡の中で「正しさ」が過剰に強化されることで、個人は自身の判断に過信し、極端な行動に走る危険性が高まります。

健全な情報環境を構築するためには、多角的なアプローチが不可欠です。個人レベルでは、多様な情報源を意識的に利用し、批判的思考力を養うとともに、自身の情報接触の偏りを客観視し、確証バイアスを認識する自己省察が求められます。ブラウザ設定やSNS機能の活用も、技術的な側面から情報の偏りを軽減する手助けとなります。

プラットフォーム側も、アルゴリズムの透明性向上や誤情報対策に積極的に取り組んでいますが、エンゲージメントを重視するビジネスモデルとの間に内在する緊張関係は依然として課題です。しかし、プラットフォームが意図的にフィルターバブルを抑制しようとする動きが見られることは、社会的な責任を認識し、より倫理的なアルゴリズム設計へと向かう可能性を示唆しています。

最終的に、情報化社会を適切に生き抜くためには、教育を通じたデジタルリテラシーの向上が極めて重要です。多様な視点に触れる機会を提供し、批判的思考力を育む教育は、社会の分断を防ぎ、健全な公共的議論を促進する基盤となります。オンラインだけでなく、オフラインでの多様な人々との交流も、情報の偏りを是正し、相互理解を深める上で不可欠な要素です。エコーチェンバーとフィルターバブルの問題は、技術的解決策だけでなく、個人の意識変革、プラットフォームの責任、そして社会全体の教育的努力が一体となって取り組むべき、複合的な課題であると言えるでしょう。

#エコーチェンバー #フィルターバブル #横田秀珠 #情報リテラシー #情報リテラシー論 #情報リテラシーセミナー #情報リテラシーコンサルタント #情報リテラシー講座 #情報リテラシー講習 #情報リテラシー講演 #情報リテラシー講師 #情報リテラシー研修 #情報リテラシー勉強会 #情報リテラシー講習会