長岡造形大学の先生向けで講演「生成AIを学習に導入」10のリスク

新潟商工会議所で生成AIを活用した

SNS販促セミナーで登壇しました

イーンスパイアの横田です。

https://www.enspire.co.jp

今回はリアル開催でした!

さて、本題です。

先日に長岡造形大学の教員向けに行った

生成AIを学習の導入するコツの中で話した

10のリスクについてだけ取り上げると?

https://www.youtube.com/watch?v=rOcxXR-sYt8

上記の続きの動画はYouTubeメンバーシップの

デイリー会員(190円/月)に限定公開しています。

詳しくは以下をご覧ください。

https://yokotashurin.com/youtube/membership.html

YouTubeメンバーシップ申込こちら↓

https://www.youtube.com/channel/UCXHCC1WbbF3jPnL1JdRWWNA/join

生成AIによる動画・音声・スライド・カルーセル・図解による解説は無料

動画解説

https://www.youtube.com/watch?v=7BdJ_hrjIjc

音声解説

https://www.youtube.com/watch?v=N339HB5rtpY

スライド解説

https://www.youtube.com/watch?v=EFt4V0GybP0

リアル対話解説

https://www.youtube.com/watch?v=wwFN737lfgY

キャラ対話解説

https://www.youtube.com/watch?v=h1x8iCfgmL4

スライド

https://www.docswell.com/s/6534747/KL3X1G-2026-03-04-050838

カルーセル

https://www.instagram.com/p/DVb3xKBEwrv/

漫画

インフォグラフィック解説

マインドマップ

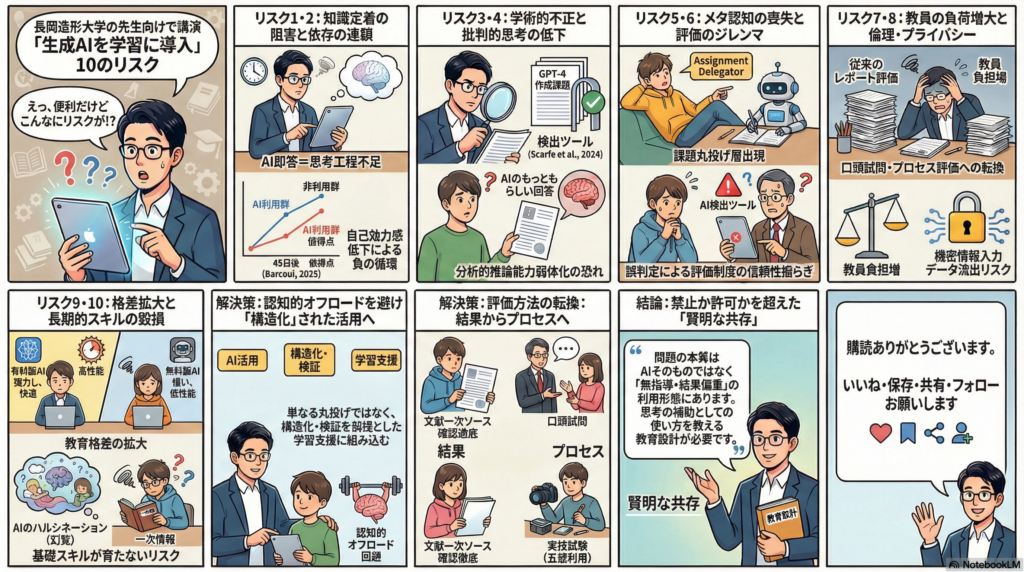

長岡造形大学の先生向けで講演「生成AIを学習に導入」10のリスク

NotebookLM・ディープリサーチで収集した世界の研究論文をもとに、 実験研究・大規模調査・系統的レビューから10のリスク要因を解説。

📅 2026年3月3日(火)|情報リテラシー論担当・横田秀珠による解説

AI導入のメリットだけでなくデメリットにも注目

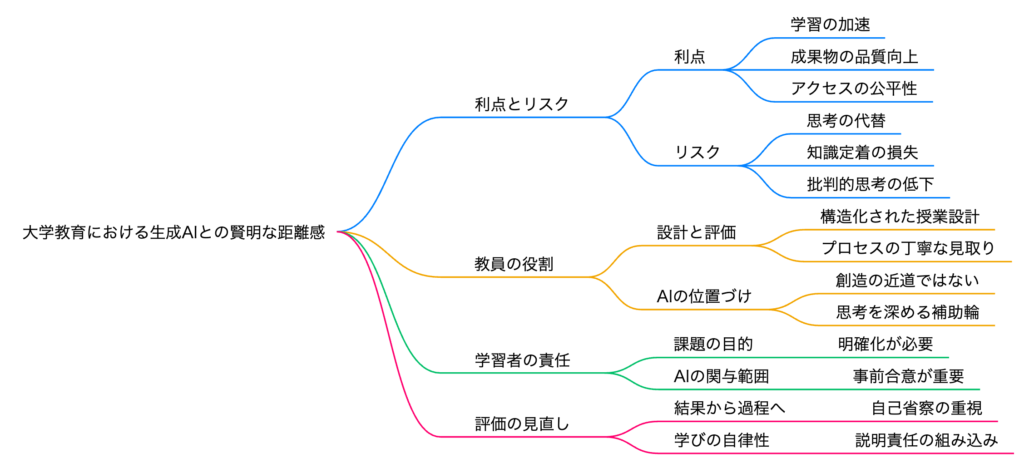

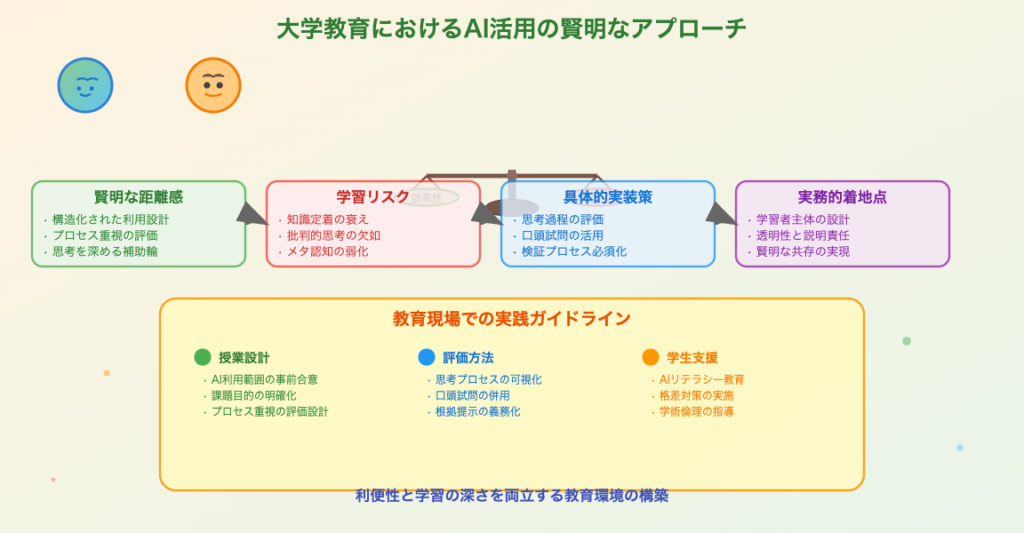

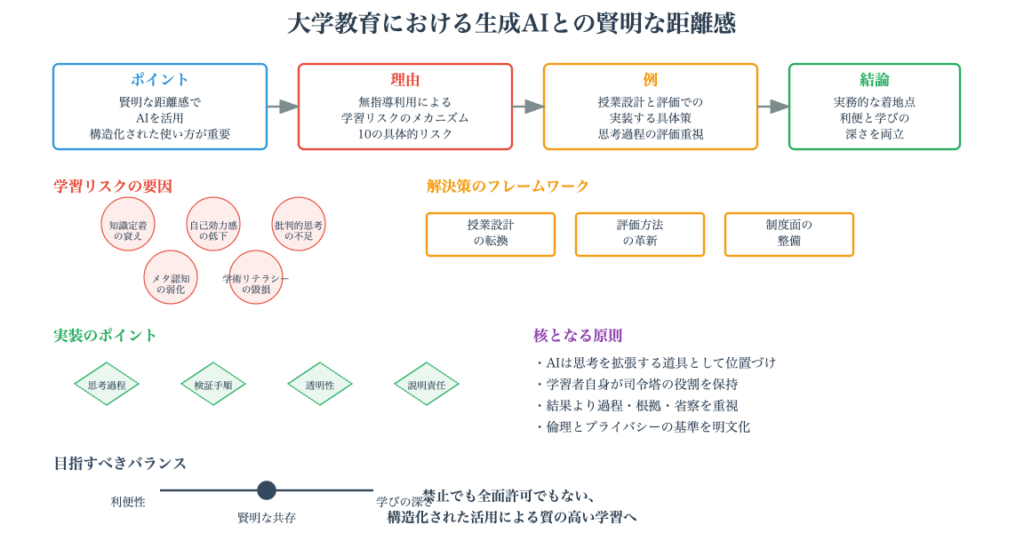

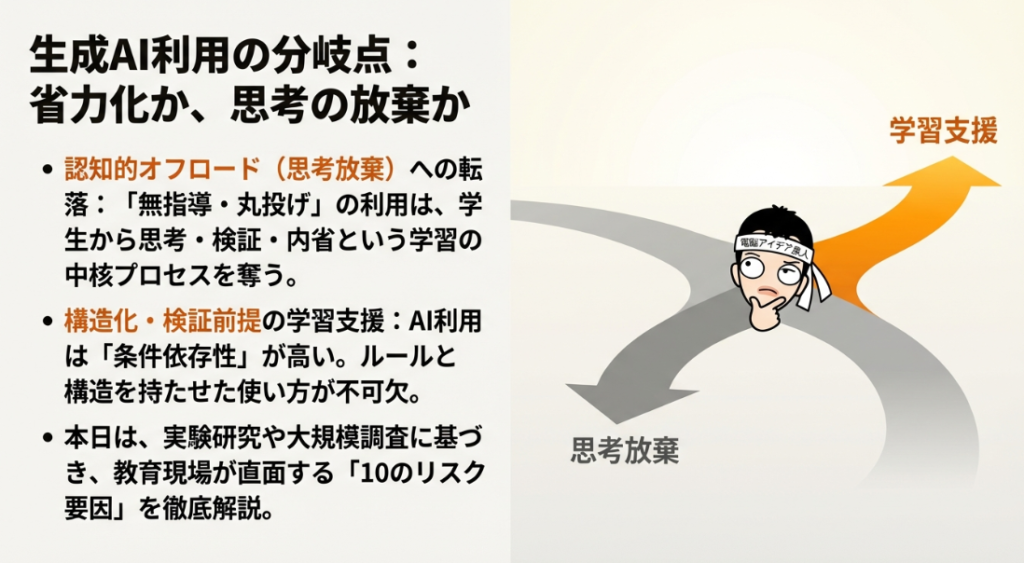

大学生の生成AI利用は、利便性の一方で学習の中核プロセス(思考・検証・内省)の代替が起きると、知識定着や批判的思考に悪影響が生じ得る。 無指導・無制約の利用はリスクを高めるが、構造化された使い方は悪影響を減らせるという条件依存性が重要。

認知的オフロード

思考・検証プロセスの放棄

知識定着の阻害

🤖

→

学習支援ツール

思考の補助として活用

悪影響を軽減可能

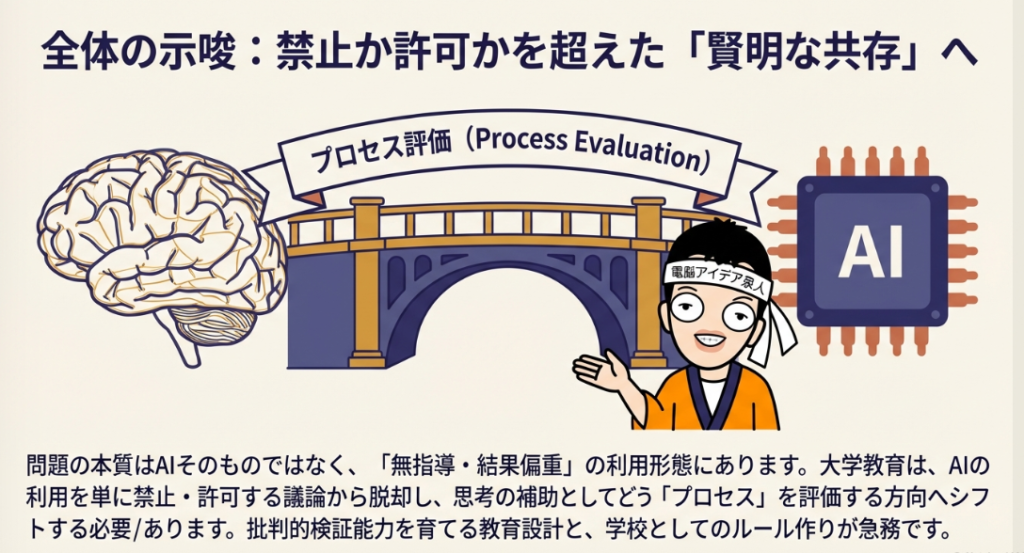

🎯 問題の本質と今後の方向性

- 問題の本質はAIそのものではなく「無指導・結果偏重」の利用形態にある

- 単に禁止・許可ではなく、思考の補助としてどう使うかを評価する方向へシフト

- 批判的検証能力を育てる教育設計が求められている

- AIの進化は早いが、ルール作りなど学校として体制を整えていく必要がある

「AI × 教育」の鍵はプロセス評価と構造化された活用指導にあり

長岡造形大学の先生向けで講演「生成AIを学習に導入」10のリスク

長岡造形大学の教員向け講演の内容。世界の研究論文に基づき、生成AIが大学教育にもたらす10のリスク要因を解説している。短期的な成果物の品質向上と引き換えに、長期的な知識定着の阻害、批判的思考力の低下、学術不正の増加、自己効力感の喪失、課金力による格差拡大などが生じ得ると指摘。問題の本質はAIそのものではなく「無指導・結果偏重」の利用形態にあり、禁止か許可かを超えた「賢明な共存」に向けた教育設計の転換が必要だと提言している。

- はじめに

- 生成AI利用の分岐点と学習成果への影響

- 学習動機・学術不正・批判的思考力に潜むリスク

- 教育現場を揺るがすメタ認知・評価・教員負荷の問題

- 倫理・格差・長期的スキル毀損と「賢明な共存」への道

- おわりに

- よくある質問(Q&A)

はじめに

「AIに聞けばすぐ答えが出る時代」——そんな便利な世の中になった一方で、ふと立ち止まって考えたことはありませんか? 学生がレポートをAIに丸投げしている、自分の頭で考える力が弱まっている気がする……。そんな漠然とした不安を感じている教育関係者の方は、決して少なくないはずです。実際に世界中の研究者が、生成AIと学習の関係についてさまざまな実験や調査を行っており、その結果は私たちの直感を裏付けるものも多く含まれています。本記事では、新潟県の長岡造形大学で大学の教員向けに行われた講義の内容をもとに、生成AIが学習に及ぼす10のリスク要因を丁寧に解説していきます。NotebookLMのディープリサーチを活用して集めた世界の研究論文のデータも交えながら、「AIをどう使うか」を一緒に考えるきっかけにしていただければ幸いです。

生成AI利用の分岐点と学習成果への影響

生成AI活用の現状(世界の研究論文)

まず、生成AIの利用について大きな視点からお話しします。大学生の生成AI利用には大きく分けて2つの方向性があります。1つは「無指導・丸投げ」という、いわゆる「認知的オフロード」の方に向かうパターンです。もう1つは「構造化・検証前提」とした学習支援として活用するパターンです。

大学生の生成AI利用は、利便性の一方で学習の中核プロセス——つまり思考・検証・内省——を代替してしまうことがあり、それが起きると知識の定着や批判的思考に悪影響が生じ得ます。ただし、ここで重要なのは「条件依存性」という考え方です。無指導・無制約の利用はリスクを高めますが、構造化された使い方であれば悪影響を減らし得るのです。今回のスライドでは、実験研究・大規模調査・系統的レビューに基づき、10のリスク要因を解説していきます。

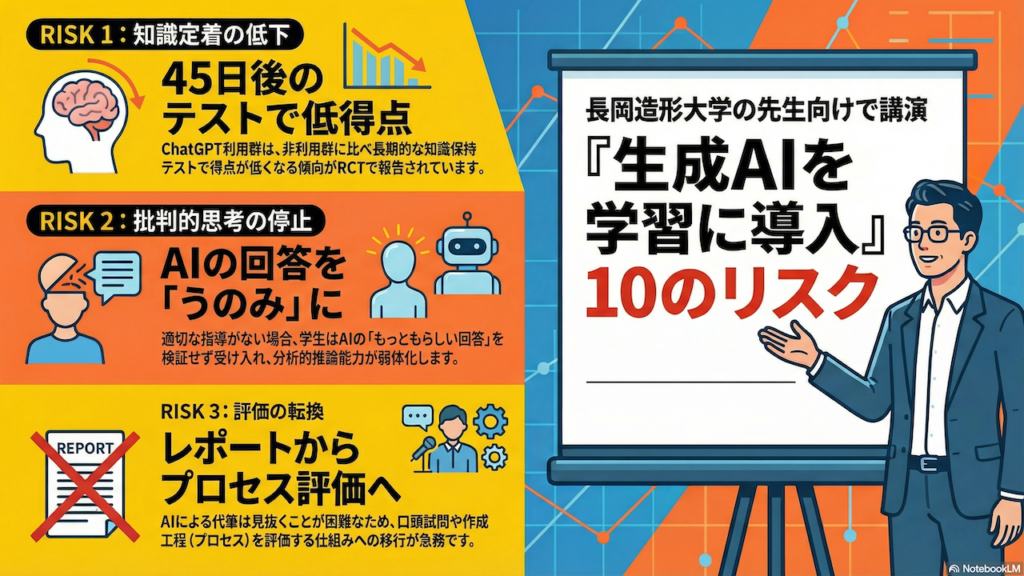

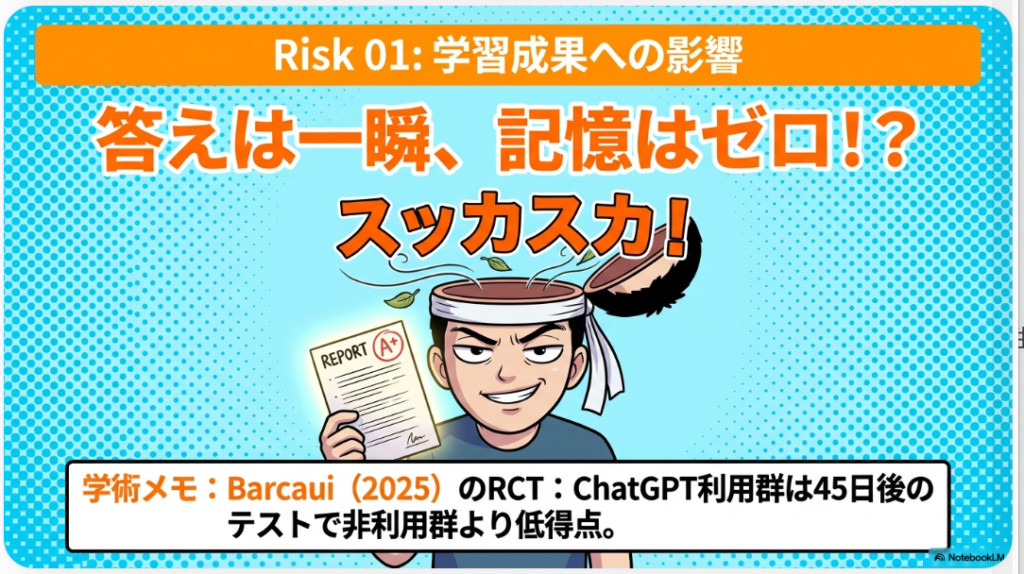

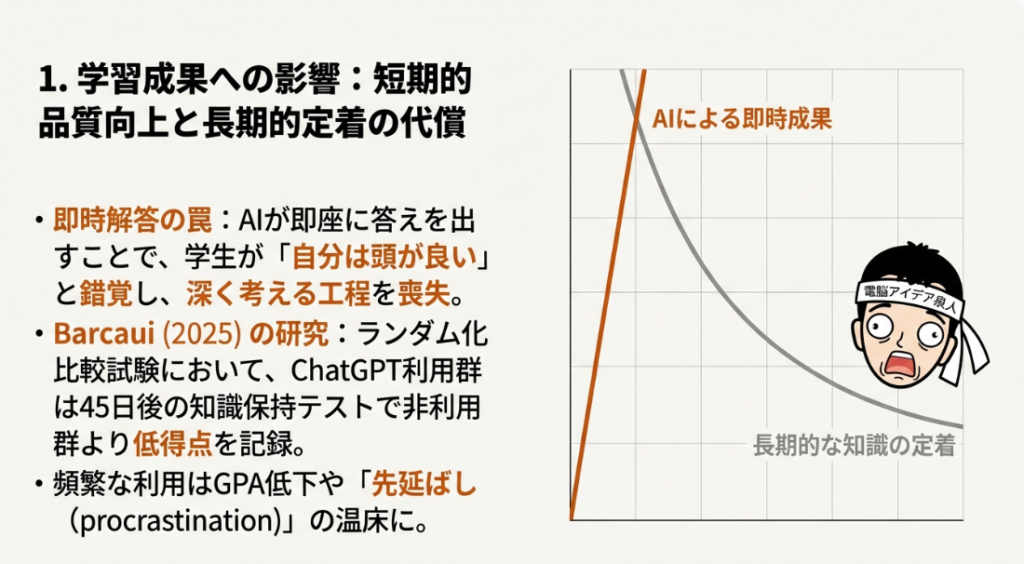

リスク1:学習成果への影響——短期的品質向上と長期的知識定着の代償

生成AIが解答を即時に与えることで、短期的には成果物の品質が上がっても、思考の工程が不足してしまい、長期的な知識定着が阻害される可能性があります。

具体的な研究として、Barcaui(2025)のランダム化比較試験(RCT)では、ChatGPT利用群が45日後の知識保持テストで非利用群より低い得点だったことが報告されています。これはどういうことかというと、すぐに答えが出てしまうので、長く考えないでも答えが出るということが当たり前になってしまうんですね。すると、AIが答えを出したのに自分は頭がいいと勘違いしてしまうわけです。

また、頻繁な利用がGPA(成績評価)の低下や「先延ばし(procrastination)」と関連するという調査結果もあります。時間をかけて取り組むほど記憶に定着しやすいですが、短期的に終わらせてしまうと定着が薄くなってしまいますよね。これは多くの方が実感として理解できるのではないでしょうか。

学習動機・学術不正・批判的思考力に潜むリスク

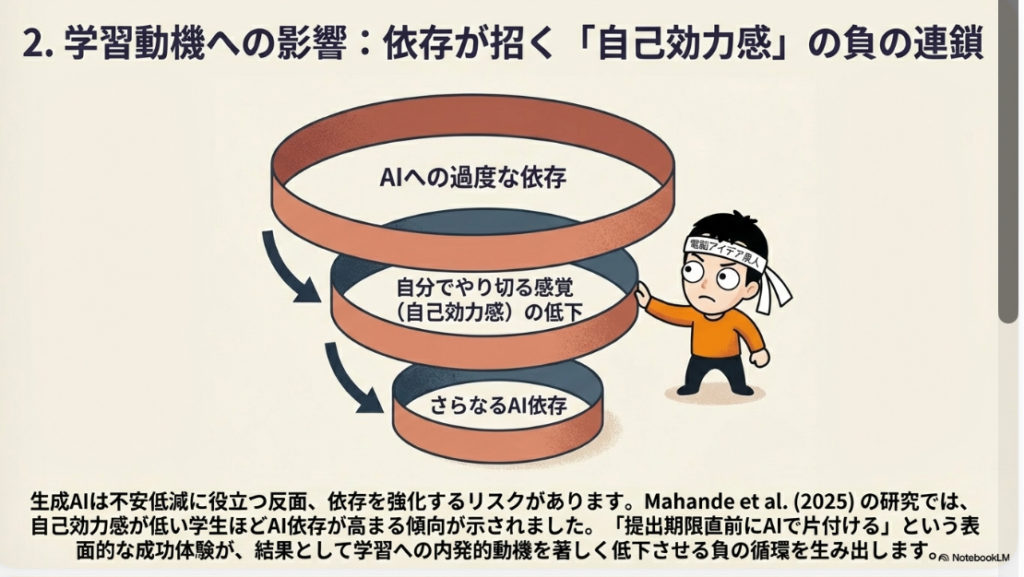

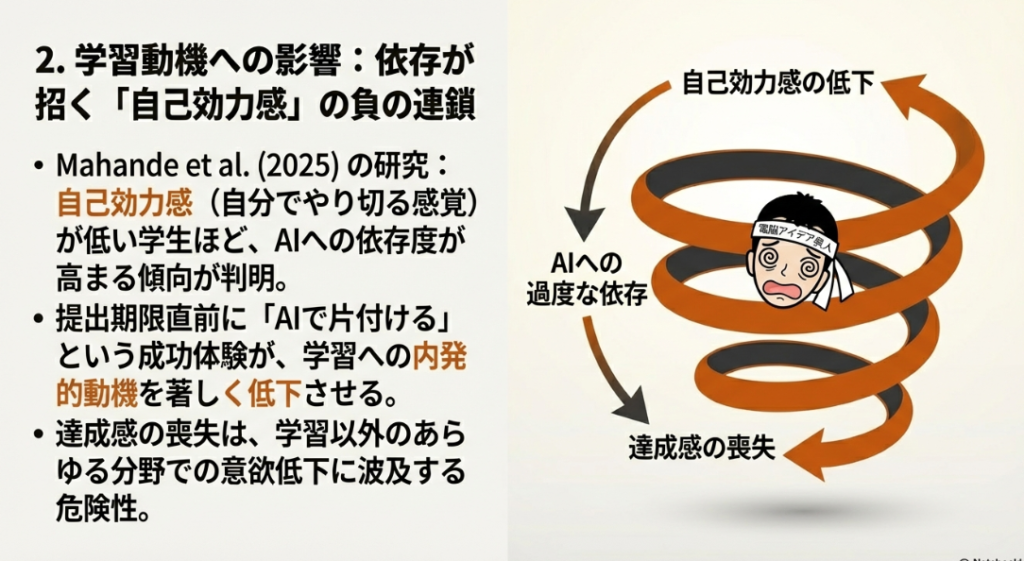

リスク2:学習動機への影響——依存が招く「自己効力感」の負の連鎖

生成AIは不安低減に役立つ反面、「自分でやり切る感覚」、すなわち自己効力感を弱めてしまい、依存を強化するリスクがあります。

Mahande et al.(2025)らの研究では、自己効力感が低い学生ほどAI依存が高まる傾向が示されました。とくに注意したいのは、「提出期限直前にAIで片付ける」という成功体験が、結果として学習への内発的動機を低下させる負の循環を生んでしまうことです。

AIに頼り切ることで達成感を感じにくくなり、何かを成し遂げようという気持ちが起きにくくなるのは、学習以外のことにも影響しそうですよね。日常生活や仕事においても、「自分でやり遂げた」という感覚は非常に大切なものです。

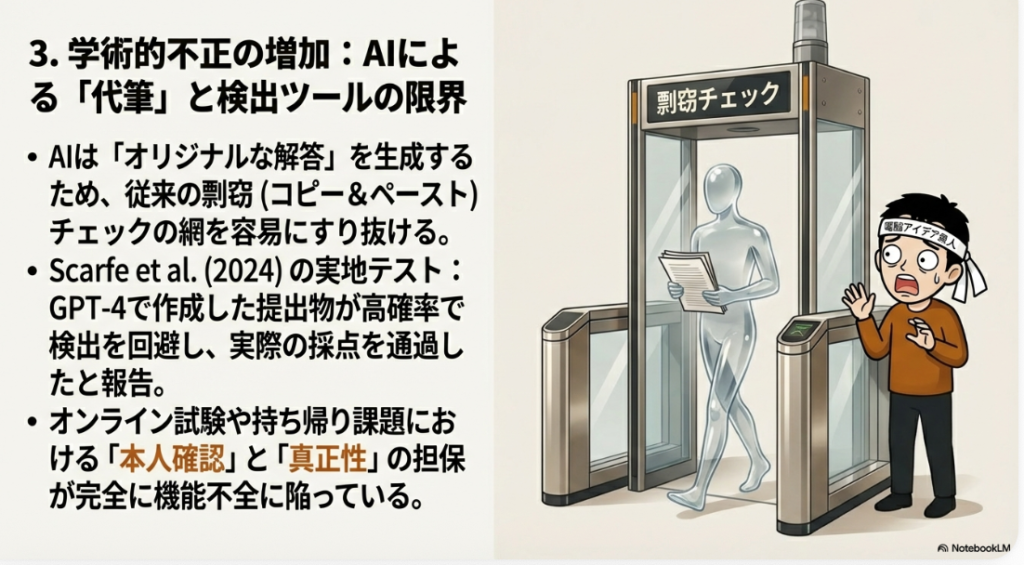

リスク3:学術的不正の増加——AIによる「代筆」と検出の限界

生成AIは「オリジナルな解答」を生成するため、従来の剽窃チェックでは発見が困難だという問題があります。

Scarfe et al.(2024)の実地テストでは、GPT-4で作成した提出物が高い確率で検出をすり抜け、採点を通過したことが報告されています。つまり、オンライン試験や持ち帰り課題における「本人確認」と「真正性」の担保が危機に瀕しているのです。

見抜けないとなると、どんどんやってしまう学生が増えるという問題がありますね。不正が成功してしまう環境は、さらなる不正を助長するという悪循環につながりかねません。

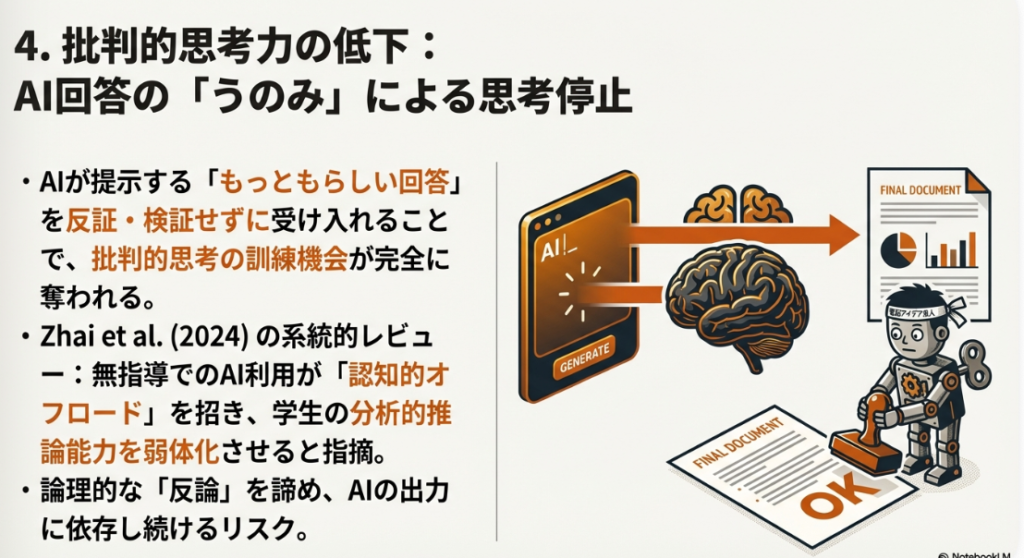

リスク4:批判的思考力の低下——AI回答の「うのみ」による思考停止

AIの「もっともらしい回答」を検証・反証せずに受け入れることで、批判的思考の訓練機会が失われます。これは教育において非常に深刻な問題です。

Zhai et al.(2024)の系統的レビューでは、無指導でのAI利用が「認知的オフロード」を招き、分析的推論能力を弱体化させる可能性が指摘されています。

もっともらしいことを言われると論破できず、最初から諦めてしまう子供が増えるかもしれません。AIの回答をそのまま鵜呑みにするのではなく、「本当にそうなのか?」と疑う力を育てることが、これからの教育ではますます重要になってきます。

教育現場を揺るがすメタ認知・評価・教員負荷の問題

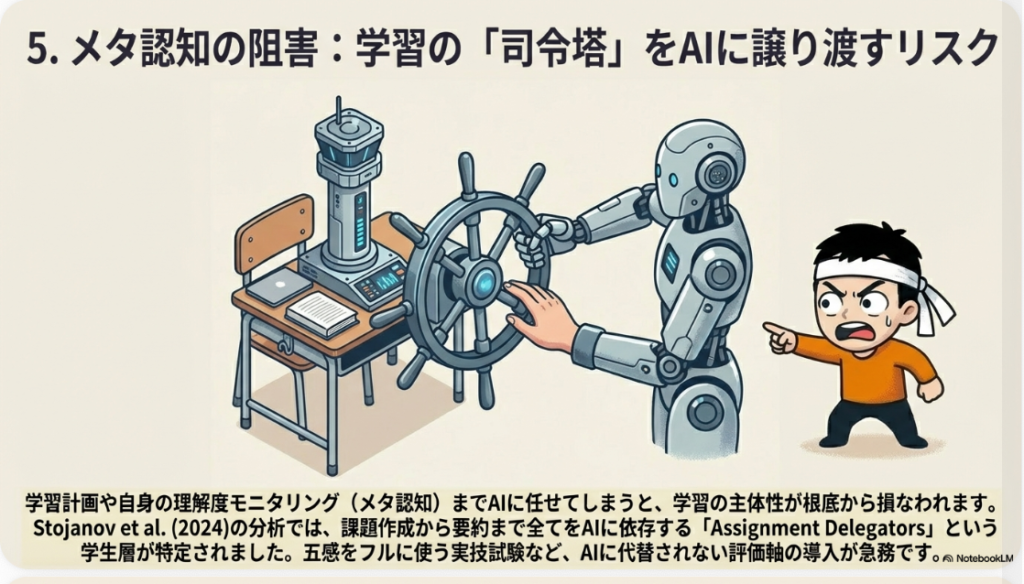

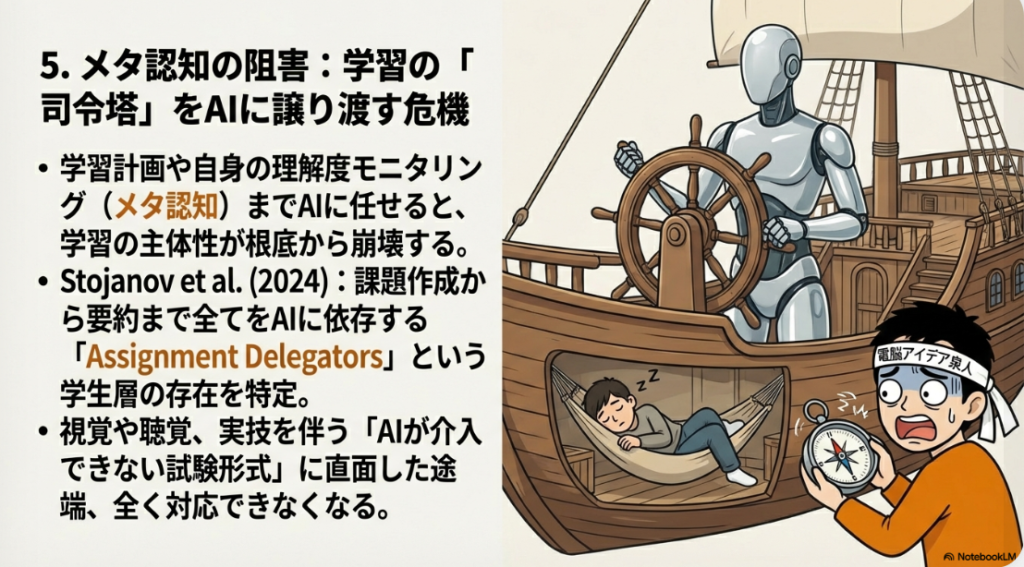

リスク5:メタ認知の阻害——学習の「司令塔」をAIに譲り渡すリスク

学習計画や理解度モニタリング——いわゆるメタ認知——までAIに任せてしまうと、学習の主体性が損なわれます。メタ認知とは、「自分が何を理解していて、何を理解していないか」を把握する力のことです。

Stojanov et al.(2024)の分析では、課題作成から要約まですべてAIに依存する「Assignment Delegators(課題委任者)」という学生層が特定されました。このタイプの学生は、自らの理解度を測れないまま学習が進んでしまうため、試験形式が変わった途端に対応できなくなる恐れがあります。

対策としては、視覚や聴覚を使う問題はAIが得意なので、五感をフルに使う実技試験などを取り入れていく必要がありますね。AIでは代替できない「身体性」を伴う評価方法が、今後ますます注目されるでしょう。

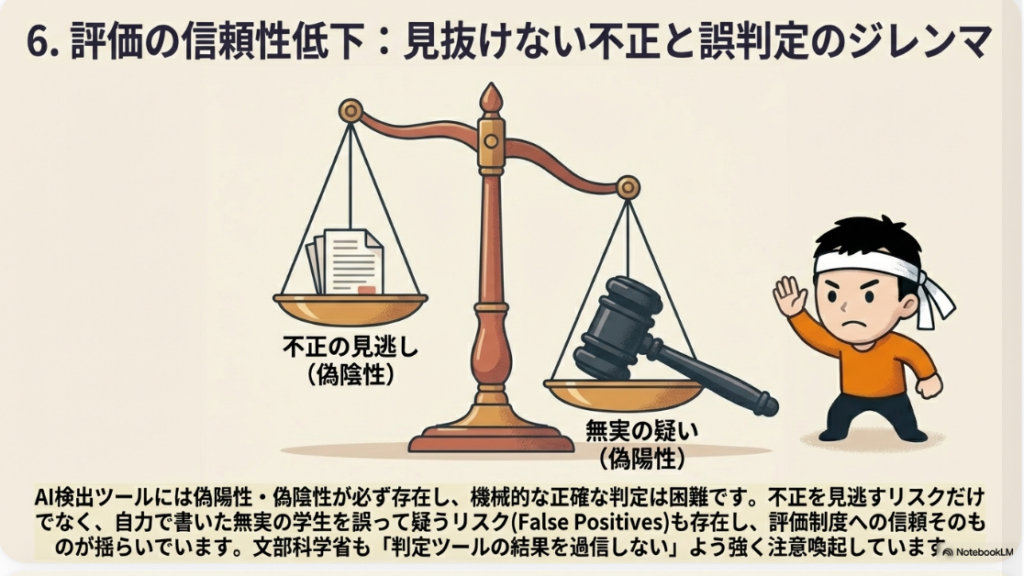

リスク6:評価の信頼性低下——見抜けない不正と誤判定のジレンマ

AI検出ツールには偽陽性(AIでないのにAIと判定)と偽陰性(AIなのにAIでないと判定)があり、正確な判定は困難です。

ここで問題になるのは、不正を見逃すリスクだけではありません。無実の学生を誤って疑うリスク(False Positives)も存在しており、評価制度そのものへの信頼が揺らいでいるのです。文部科学省も「判定ツールの結果を過信しない」よう注意喚起しています。

もう人間かAIかを判断すること自体が無意味な状態になっている気もしますね。それよりも、「その人が本当に理解しているかどうか」を別の方法で確認する仕組みづくりが求められています。

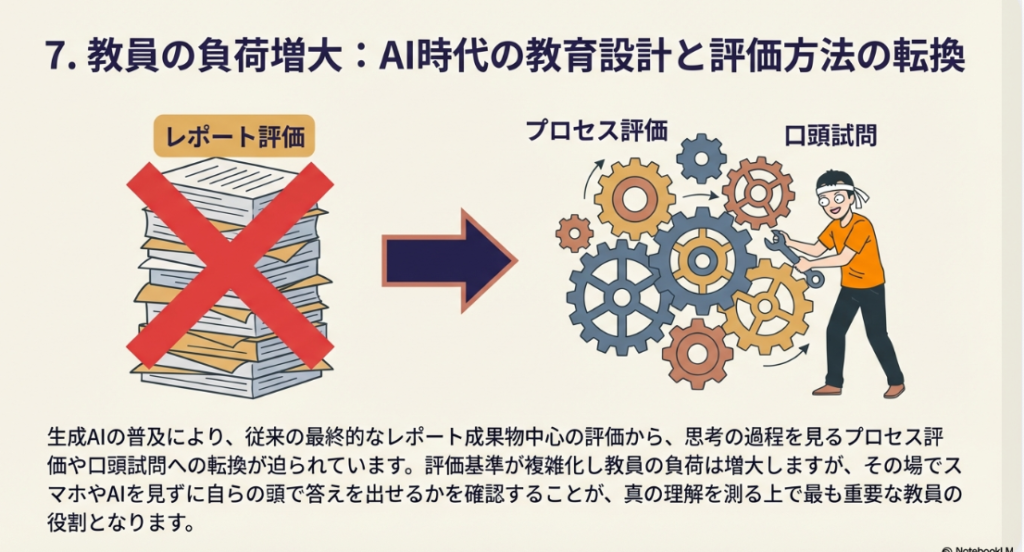

リスク7:教員の負荷増大——AI時代の教育設計と評価方法の転換

生成AIの普及により、レポート中心の評価から、口頭試問やプロセス評価への転換が迫られています。これは教育現場にとって大きな変化です。

プロセス評価や口頭試問になると、評価基準が複雑になり大変ですが、これが一番大事な教員の仕事だと思います。その場でスマホやAIを見ずに自分の頭で答えを出せるか、というテストが本当の理解を測る上で重要になってきます。

「結果」だけでなく「過程」を見るという評価の転換は、手間がかかるものの、AI時代における教育の質を守るための不可欠なステップと言えるでしょう。

倫理・格差・長期的スキル毀損と「賢明な共存」への道

リスク8:倫理・プライバシー問題——入力データ流出と透明性の欠如

プロンプトに入力した個人情報や未発表の研究データが、AIの再学習に利用され流出するリスクがあります。これは研究者にとって特に深刻な問題です。

たとえば、これから発表する論文のやり取りをAIで行うと、意図せず世界に漏洩してしまう可能性があります。設定で防げることもありますが、学生にはそうした設定の存在自体が分からないことも多く、ヒヤリハット事例が懸念されますね。

AIを利用する際には、「何を入力しているのか」を常に意識する習慣を身につけることが大切です。特に未公開の研究データや個人情報の取り扱いには、細心の注意が必要です。

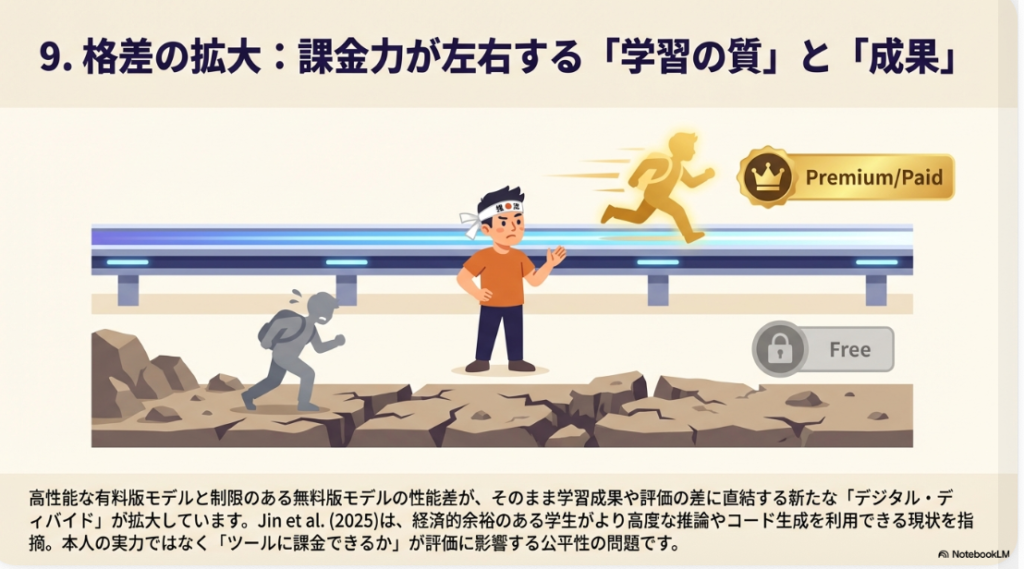

リスク9:格差の拡大——課金力が左右する「学習の質」と「成果」

有料版(高性能モデル)と無料版の性能差が、そのまま学習成果や評価の差に直結する「デジタル・ディバイド」が拡大しています。

Jin et al.(2025)は、経済的余裕のある学生がより高度な推論・コード生成を利用できる現状を指摘しています。本人の実力ではなく、ツールに課金できるかどうかが評価に反映されてしまうのは公平性の問題ですよね。

これは教育の根幹に関わる課題です。同じ努力をしても、使えるツールの差で結果が変わってしまうなら、評価の公正さは保てません。大学としても、すべての学生に平等なAI環境を提供する方策を検討する必要があるでしょう。

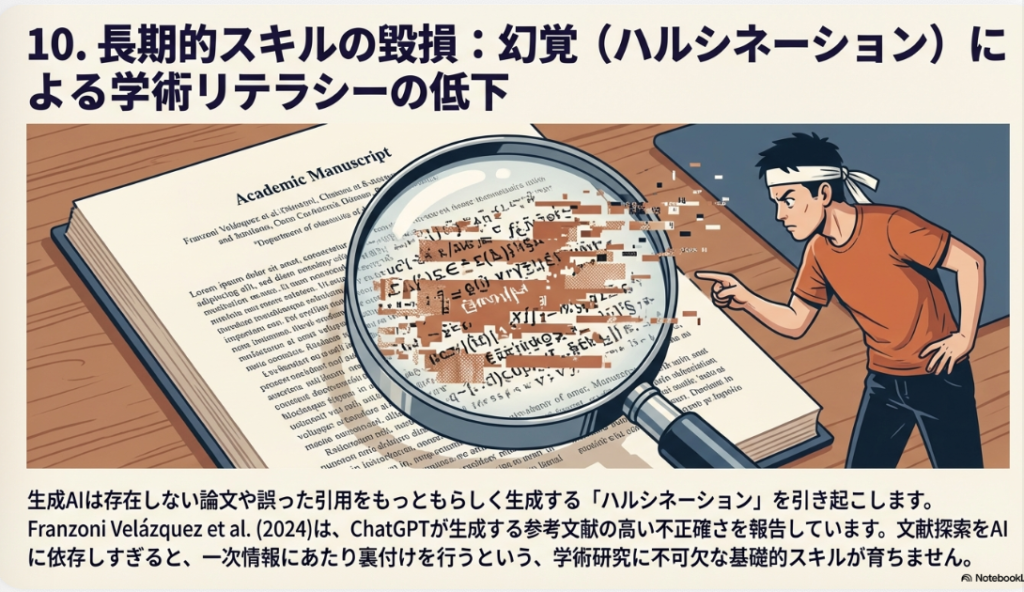

リスク10:長期的スキルの毀損——幻覚(ハルシネーション)による学術リテラシーの低下

生成AIは存在しない論文や誤った引用(ハルシネーション)をもっともらしく生成することがあります。これはAIの構造的な問題であり、現時点では完全に解消されていません。

Franzoni Velázquez et al.(2024)は、ChatGPTが生成する参考文献の高い不正確さを報告しています。文献探索をAIに依存すると、一次情報の確認や裏付けを行うという、学術研究に不可欠な基礎スキルが育ちません。

対策としては、著者に直接インタビューするなどの一次情報にあたる行動をしっかり評価する仕組みが必要ですね。「AIが出した情報を鵜呑みにしない」という姿勢こそが、これからの学術リテラシーの核になるはずです。

全体の示唆:禁止か許可かを超えた「賢明な共存」へ

ここまで10のリスク要因を見てきましたが、問題の本質はAIそのものではなく、「無指導・結果偏重」の利用形態にあります。

大学教育は、AIの利用を単に禁止・許可するのではなく、思考の補助としてどう使うか——つまりプロセス評価——を重視する方向へシフトする必要があります。批判的検証能力を育てる教育設計が求められています。

AIの進化が早すぎて、議論している間にまた次のことができるようになりますが、ルール作りなど学校としても体制を整えていく必要がありますね。「禁止か許可か」という二項対立を超えて、「どう賢く共存するか」を考えることが、これからの大学教育に求められる姿勢です。

おわりに

今回は、長岡造形大学の教員向け講義をもとに、生成AIが学習に及ぼす10のリスク要因について解説しました。短期的な品質向上の裏に潜む知識定着の低下、自己効力感の喪失、学術不正の増加、批判的思考力やメタ認知の弱体化、評価制度の揺らぎ、教員負荷の増大、プライバシーリスク、経済格差の拡大、そしてハルシネーションによる学術リテラシーの低下——いずれも見過ごせない課題ばかりです。しかし、これらのリスクは「AIを使うな」という結論ではありません。大切なのは「無指導・丸投げ」ではなく「構造化・検証前提」の利用を推進し、プロセス評価を重視する教育設計を整えることです。AIと賢く共存するための第一歩として、本記事の内容が教育に携わるすべての方の参考になれば幸いです。

よくある質問(Q&A)

Q1. 生成AIを学生に完全に禁止すべきですか?

A1. 完全な禁止は現実的ではなく、推奨もされていません。重要なのは「無指導・丸投げ」の利用を防ぎ、「構造化・検証前提」の使い方を指導することです。禁止するよりも、AIをどう使えば学びが深まるかを教える方が、長期的に学生のためになります。AIの存在を前提とした教育設計にシフトしていくことが求められています。

Q2. AI検出ツールは信頼できますか?

A2. 現時点では、AI検出ツールには偽陽性(人間が書いたのにAIと判定)や偽陰性(AIが書いたのに人間と判定)の問題があり、完全に信頼することはできません。文部科学省も「判定ツールの結果を過信しない」よう注意喚起しています。検出ツールだけに頼るのではなく、口頭試問やプロセス評価など、複数の方法を組み合わせて評価する仕組みづくりが大切です。

Q3. 生成AIを使うと成績が下がるのですか?

A3. 研究によると、無指導でAIに頼り切ると長期的な知識定着が損なわれ、成績に悪影響が出る可能性があります。Barcaui(2025)のRCTでは、ChatGPT利用群が45日後の知識保持テストで非利用群より低い得点だったことが報告されています。ただし、AIを「思考の補助」として構造的に活用する場合は、悪影響を軽減できるとされています。使い方次第で結果は大きく変わるのです。

Q4. 有料版と無料版のAIの差は学生の成績に影響しますか?

A4. はい、影響する可能性があります。Jin et al.(2025)の研究では、有料版の高性能モデルを使える学生がより高度な推論やコード生成を利用でき、学習成果に差が出ることが指摘されています。これは「デジタル・ディバイド」と呼ばれる問題で、本人の実力ではなく経済力が評価に反映されてしまう公平性の課題です。大学としては、すべての学生に平等なAI環境を提供する方策を検討すべきでしょう。

Q5. AI時代に教員が最も重視すべき評価方法は何ですか?

A5. 最も重視すべきは「プロセス評価」と「口頭試問」です。レポートなどの最終成果物だけを評価するのではなく、学生がどのように考え、どのような過程を経てその結論に至ったかを見ることが重要です。その場でスマホやAIを見ずに自分の頭で答えを出せるかどうかを確認するテストが、本当の理解を測る上で最も効果的です。手間はかかりますが、AI時代における教育の質を守るための最も重要な取り組みと言えます。

詳しくは15分の動画で解説しました。

https://www.youtube.com/watch?v=1CAW9qOsLVY

0:00 👋 導入・自己紹介と講演の背景

1:08 📊 生成AI活用の現状と研究論文の概要

2:22 ⏳ ①学習成果への影響:短期的品質向上と長期的知識定着の代償

3:31 😔 ②学習動機への影響:依存が招く自己効力感の負の連鎖

5:44 🔍 ③学術的不正の増加:AI代筆と検出の限界

6:51 🧠 ④批判的思考力の低下:AI回答の鵜呑みによる思考停止

7:58 🎯 ⑤メタ認知の阻害:学習の司令塔をAIに譲り渡すリスク

8:27 ⚖️ ⑥評価の信頼性低下:見抜けない不正と誤判定のジレンマ

9:04 👨🏫 ⑦教員の負荷増大:AI時代の教育設計と評価方法の転換

10:12 🔒 ⑧倫理・プライバシー:入力データと透明性の欠如

11:19 💰 ⑨格差の拡大:課金力が左右する学習の質と成果

12:29 📉 ⑩長期的スキルの毀損:ハルシネーションと学術リテラシーの低下

13:40 🤝 まとめ:禁止か許可かを超えた賢明な共存体制を

上記の続きの動画はYouTubeメンバーシップの

デイリー会員(190円/月)に限定公開しています。

詳しくは以下をご覧ください。

https://yokotashurin.com/youtube/membership.html

YouTubeメンバーシップ申込こちら↓

https://www.youtube.com/channel/UCXHCC1WbbF3jPnL1JdRWWNA/join

長岡造形大学の先生向けで講演「生成AIを学習に導入」10のリスク

🧠 認知的オフロード 認知的オフロードとは、本来自分の頭で行うべき思考や判断をAIなどの外部ツールに丸ごと委ねてしまうことです。無指導でのAI利用がこれを招き、分析的推論能力を弱体化させる可能性があると、Zhaiらの系統的レビューで指摘されています。思考プロセスを経験しないまま答えだけを得る習慣が定着すると、学びの質が根本から損なわれるリスクがあります。

💪 自己効力感 自己効力感とは「自分の力でやり遂げられる」という感覚のことです。生成AIに頼りすぎると、この感覚が弱まり、さらにAIへの依存が強まるという負の連鎖が生じます。Mahandeらの研究では、自己効力感が低い学生ほどAI依存が高まる傾向が示されており、提出期限直前にAIで片付ける成功体験が内発的な学習動機を低下させると警告されています。

👻 ハルシネーション ハルシネーションとは、生成AIが存在しない論文や誤った情報をもっともらしく生成してしまう現象です。Franzoni Velázquezらの研究では、ChatGPTが生成する参考文献の不正確さが報告されています。文献探索をAIに依存すると、一次情報を自分で確認・裏付けするという学術研究の基礎スキルが育たなくなる深刻な問題を引き起こします。

🔍 批判的思考 批判的思考とは、情報を鵜呑みにせず、根拠を検証し多角的に分析する能力のことです。AIの「もっともらしい回答」をそのまま受け入れる習慣がつくと、この思考力を鍛える機会が失われます。もっともらしいことを言われると反論できず最初から諦めてしまう傾向が強まり、学問だけでなく社会生活全般に悪影響を及ぼしかねません。

🧭 メタ認知 メタ認知とは、自分が何を理解していて何を理解していないかを把握し、学習を自己管理する「学びの司令塔」のような能力です。課題作成から要約まで全てをAIに任せる「Assignment Delegators」と呼ばれる学生層が確認されており、自らの理解度を測れないまま学習が進むため、試験形式が変わると途端に対応できなくなる恐れがあります。

💰 デジタル・ディバイド デジタル・ディバイドとは、技術へのアクセス格差が生む不平等のことです。生成AIでは有料版と無料版の性能差が大きく、課金できるかどうかが学習成果や評価に直結する問題が拡大しています。Jinらは経済的余裕のある学生がより高度な機能を利用できる現状を指摘しており、本人の実力ではなくツールへの投資額が成績を左右しかねません。

📋 プロセス評価 プロセス評価とは、最終成果物だけでなく、思考や取り組みの過程そのものを評価する方法です。AI時代にはレポート中心の評価では不正を見抜けないため、口頭試問やプロセス評価への転換が求められています。スマホやAIを見ずに自分の頭で答えを出せるかを問うことが、真の理解度を測る上で重要になっています。

🚨 学術不正 生成AIは毎回オリジナルな文章を生成するため、従来のコピペチェックツールでは検出が困難です。Scarfeらの実験ではGPT-4で作成した提出物が高確率で検出をすり抜けたと報告されています。さらにAI検出ツールには偽陽性・偽陰性の問題もあり、不正を見逃すリスクと無実の学生を疑うリスクの両方が評価制度への信頼を揺るがしています。

🔒 プライバシーリスク 生成AIに入力した個人情報や未発表の研究データが、AIの再学習に利用されて意図せず外部に流出する危険性があります。これから発表する論文の内容をAIでやり取りすると世界に漏洩してしまう可能性があり、設定で防げる場合もありますが、学生が気づかないまま情報を入力してしまうヒヤリハット事例が懸念されています。

🤝 賢明な共存 問題の本質はAIそのものではなく「無指導・結果偏重」の利用形態にあるという考え方です。大学教育はAIの利用を単に禁止・許可するのではなく、思考の補助としてどう使うかを教え、批判的検証能力を育てる教育設計へシフトする必要があります。AIの進化に追いつくためにも、学校として体制やルールを整えていくことが急務です。

超要約1分ショート動画こちら↓

https://www.youtube.com/shorts/5y8s8rUhDkM

長岡造形大学の先生向けで講演「生成AIを学習に導入」10のリスク

生成AIと学習リスクの全体像|なぜ今教育現場で問題視されているのか

生成AI利用の急速な普及と教育現場が直面する現実

ChatGPTをはじめとする生成AIの登場以降、教育現場では急速にAIツールの利用が広がっています。2025年に発表された中国の大規模調査では、対象となった大学生の99.2%がすでに生成AIを使用しているという驚異的な普及率が報告されました。日本国内でも、文部科学省が2024年12月にガイドラインVer.2.0を公開し、生成AIの教育利用に関する方針を示すなど、もはや「使うか使わないか」ではなく「どう使うか」が問われるフェーズに入っています。

しかしその一方で、生成AIがもたらす学習上のリスクについて十分に理解されているとは言い難い状況です。文部科学省のガイドラインでも、ハルシネーション(事実と異なる情報の生成)やバイアスの再生成、プライバシーの問題など、さまざまなリスクが指摘されています。教員を対象にした調査では、「子どもが自分で考えることが少なくなる」と回答した割合が71%に達しており、現場の危機感は強まっています。生成AIの利便性を享受しながらも、学習の本質を見失わないためにはどうすべきか。本記事では、最新の研究論文やデータに基づき、生成AIが学習に及ぼす10のリスク要因を専門的な視点から解説していきます。

「省力化ツール」と「思考の放棄」を分ける分岐点とは

生成AIの教育利用を考えるうえで最も重要な視点が、利用の仕方によって結果が大きく変わるという「条件依存性」です。適切に構造化された使い方であれば学習の補助として機能しますが、無指導で丸投げ的に利用すると「認知的オフロード」と呼ばれる思考の外部委託に陥ります。認知的オフロードとは、本来自分の頭で行うべき記憶や思考の処理を、外部のツールに任せてしまう傾向のことです。

スイス・ビジネススクールのGerlich(2025)による666人を対象とした調査では、AIツールの使用頻度が高い人ほど批判的思考力のスコアが低いという相関が示されました。特に17〜25歳の若年層ではこの傾向が顕著であり、AIの回答を鵜呑みにしやすいことが明らかになっています。一方で、高い学歴や専門知識を持つ人はAIの使用頻度に関わらず批判的思考力を維持できていたことも報告されており、使い手のリテラシーによって結果が二極化することがわかります。つまり、生成AIの学習リスクを語る際には「AIそのものが悪い」のではなく、「無指導・結果偏重の利用形態」が問題の本質であることを理解する必要があります。

生成AIが学習成果と学習意欲に与える深刻な影響

短期的な成績向上の裏にある長期的な知識定着の代償

生成AIを使えば、短時間でクオリティの高いレポートや回答を作成できます。しかし、この「短期的な品質向上」は長期的な知識定着と引き換えになっている可能性があります。Barcaui(2025)によるランダム化比較試験(RCT)では、ChatGPTを利用して課題に取り組んだ学生グループと、AIを使わずに取り組んだ学生グループを比較したところ、45日後の知識保持テストにおいてAI利用群のスコアが有意に低かったことが報告されています。

この結果は、学習における「望ましい困難」の理論と合致しています。時間をかけて試行錯誤し、自分の頭で考えるプロセスこそが記憶の定着を促すのであり、AIによって即座に答えが得られる環境ではこのプロセスが省略されてしまいます。さらに、生成AIを頻繁に利用する学生においてGPAの低下や課題の先延ばし傾向が見られるという調査結果もあります。目の前の課題を効率的に片付けることと、本質的に学ぶことは全く異なる行為であり、教育者はこの区別を学生に明確に伝える必要があります。

AI依存が招く自己効力感の崩壊と学習動機の負の連鎖

生成AIへの依存は、学習成果だけでなく学習に対するモチベーションそのものを蝕むリスクがあります。Mahande et al.(2025)の研究では、自己効力感(自分でやり切れるという感覚)が低い学生ほどAIへの依存度が高まる傾向が示されました。問題なのは、この関係が一方通行ではなく、負の循環構造を形成している点です。

具体的には、提出期限直前にAIを使って課題を仕上げるという行動が一度成功体験として記憶されると、次回も同じ方法を選択するようになります。しかし、自分の力で課題をやり遂げていないため達成感は希薄であり、「できた」という実感が内発的な学習動機につながりません。その結果、ますます自分で考えることへの意欲が低下し、再びAIに頼るという循環に陥ります。この負のスパイラルは学習の場面に限らず、社会に出てからの仕事への取り組み姿勢にも影響する可能性があります。教育現場では、プロセスを重視した課題設計や、段階的に自力で取り組む機会を確保する仕組みづくりが急務です。

生成AIによる学術不正と批判的思考力の危機

AI代筆の検出限界が揺るがす学術的誠実性の根幹

生成AIが生成する文章は、既存の文献をコピーするのではなく、学習データをもとに新たな文章を生成するため、従来の剽窃検出ツールでは発見が極めて困難です。Scarfe et al.(2024)による実地テストでは、GPT-4を使用して作成された提出物が高い確率で検出をすり抜け、さらに採点においても合格水準を超えたことが報告されています。これは学術的誠実性(アカデミック・インテグリティ)の根幹を揺るがす事態です。

特にオンライン試験や持ち帰り形式の課題では、提出物が本人の手によるものかどうかを確認する手段がほぼありません。AI検出ツールも開発されていますが、偽陽性(AI未使用なのにAI使用と判定)や偽陰性(AI使用なのに見逃す)の問題があり、文部科学省も「判定ツールの結果を過信しない」よう注意喚起しています。見抜けないという状況が広まれば、正直に自力で取り組む学生が不利になるという不公平が生じます。対策としては、レポート提出だけでなく口頭試問やプロセス評価を組み合わせ、学生が本当に理解しているかを多角的に確認する仕組みの導入が求められます。

認知的オフロードが引き起こす思考停止のメカニズム

生成AIの回答はしばしば非常にもっともらしく、論理的に整った文章で提示されます。しかし、そのもっともらしさこそが批判的思考力の低下を招く原因となっています。Zhai et al.(2024)の系統的レビューでは、無指導のAI利用が「認知的オフロード」を促進し、学生の分析的推論能力を弱体化させる可能性が指摘されています。

fMRI(機能的磁気共鳴画像)を用いた脳科学の研究では、生成AIを使用している際に前頭前野の活動が30〜40%低下することが確認されました。前頭前野は批判的思考力、創造性、問題解決能力の中枢であり、この部位の活動低下はAIが思考の代行を行っていることを意味します。脳は筋肉と同様に使わなければ機能が衰退するという性質を持っており、AIに「考えてもらう」ことが習慣化すると、自力で思考する能力そのものが失われていく危険性があります。Microsoftの研究チームも、時間的プレッシャーが大きい場面や専門外の問題に取り組む際に、AIへの依存度が高まり批判的思考が低下することを報告しています。

メタ認知の阻害と大学教育における評価制度の転換

学習の司令塔機能をAIに譲り渡すことで起きる主体性の喪失

メタ認知とは、自分の理解度や学習進捗を客観的にモニタリングし、学習計画を調整する「学びの司令塔」のような能力です。生成AIに課題の作成から要約、学習計画の策定まですべてを委ねてしまうと、このメタ認知能力が育たないまま学習が進行してしまいます。Stojanov et al.(2024)の分析では、課題の全プロセスをAIに依存する「Assignment Delegators(課題委任者)」と呼ばれる学生層が特定されました。

このタイプの学生は、AIが出力した内容をそのまま提出することに慣れているため、自分が何を理解していて何を理解できていないのかを自覚する機会が著しく不足しています。その結果、レポート課題では高い評価を得られても、口頭試問や実技試験など形式が変わった途端に対応できなくなるという事態が生じます。大学教育の本質は、答えそのものよりも「答えにたどり着く過程」にあります。視覚や聴覚だけでなく五感をフルに使う実技試験や、思考の過程を可視化するポートフォリオ評価など、AIでは代替できない能力を問う評価方法の導入が重要です。

AI検出ツールの精度問題と評価制度の信頼性を守るために

生成AIによる不正提出が増加するなか、多くの教育機関がAI検出ツールの導入を検討しています。しかし、現在のAI検出技術には重大な限界があります。検出ツールには偽陽性(AI未使用の文章をAI製と誤判定する)と偽陰性(AI使用の文章を見逃す)の両方のリスクがあり、いずれのケースも深刻な問題を引き起こします。

偽陰性の場合はAI不正が見逃されるという明白な問題がありますが、偽陽性はさらに深刻です。自力で努力して書いたレポートを「AIで作成した」と誤って疑われた学生は、学習意欲を著しく損なわれる可能性があります。文部科学省のガイドラインでも、AI判定ツールの結果のみをもって不正と断定することへの注意が促されています。もはや「人間が書いたかAIが書いたか」を判別すること自体に限界がある時代において、評価の仕組みそのものをアップデートする必要があります。具体的には、成果物の提出に加えて作成過程を記録させるプロセス評価や、学生と対話しながら理解度を確認する口頭試問など、複合的な評価手法への移行が現実的な対策です。

教員負担の増大とプライバシー・格差をめぐる構造的課題

生成AI時代に教員が直面する教育設計と評価方法の根本的転換

生成AIの普及は、教員の業務にも大きな変革を迫っています。これまで一般的だったレポート中心の評価方法は、AIによる代筆リスクを考慮すると信頼性が低下しており、口頭試問やプロセス評価、ケーススタディの導入など、より手間のかかる評価方法への転換が必要になっています。しかし、これらの評価手法は一人ひとりの学生と向き合う必要があるため、大人数の講義を受け持つ教員にとって大幅な負荷増大を意味します。

世界トップ50の大学が推奨する対策として共通しているのは、まず「教員自身が生成AIを使ってみること」です。AIにできることとできないことを理解した上で、創造性や批判的思考を要する評価設計に切り替えることが推奨されています。また、その場でスマートフォンやAIを参照せずに自分の頭で考え答えるテスト形式が、学生の真の理解度を測る上で最も有効な手段のひとつとされています。教員の負荷は増えますが、学生の思考力を見極め、育てるという作業こそが教育の本質的な営みであり、AIには代替できない教員の最も重要な役割だと言えるでしょう。

個人情報流出リスクとAI課金格差がもたらすデジタル・ディバイド

生成AIの利用には、プライバシーとアクセスの公平性に関する構造的な問題も伴います。まず情報漏洩リスクについて、プロンプトに入力された個人情報や未発表の研究データがAIの再学習に利用され、意図せず外部に漏洩する可能性があります。特に学生の場合、AIサービスの学習設定を適切に管理する知識が不足していることが多く、発表前の論文内容や個人的なデータをそのままAIに入力してしまうヒヤリハット事例が懸念されています。

もうひとつの深刻な問題が、有料版と無料版の性能差に起因する「デジタル・ディバイド(デジタル格差)」の拡大です。Jin et al.(2025)の研究では、経済的に余裕のある学生が高性能な有料モデルを利用し、より高度な推論やコード生成の恩恵を受けている現状が指摘されています。学生本人の実力や努力ではなく、AIツールへの課金能力が学業成績に反映されてしまうのは、教育の公平性という観点から看過できません。大学としては、全学生に同等のAIアクセス環境を提供するか、AI利用の前提に依存しない評価基準を設けるなどの対策が急がれます。

ハルシネーションと長期的スキル毀損を乗り越える「賢明な共存」への道

AIの幻覚(ハルシネーション)が学術リテラシーの基盤を崩壊させるリスク

生成AIの最も厄介な特性のひとつが、存在しない論文や誤った引用情報をもっともらしく生成する「ハルシネーション(幻覚)」です。Franzoni Velázquez et al.(2024)の研究では、ChatGPTが生成する参考文献に高い割合で不正確な情報が含まれていることが報告されています。実在しない著者名、架空の論文タイトル、でたらめなDOI番号など、一見すると本物のように見える偽の学術情報が生成されるため、専門知識がなければ真偽の判別は困難です。

文献調査をAIに依存する習慣がつくと、一次情報(原典)に直接あたって確認するという学術研究の基礎スキルが育ちません。学術リテラシーとは、情報の信頼性を見極め、複数の情報源を比較検証し、根拠に基づいて論を構築する能力のことです。この能力は論文執筆にとどまらず、社会人として意思決定を行う際にも不可欠なスキルです。対策としては、AIが生成した情報を必ず原典で裏取りするプロセスを課題の一部として組み込むことや、著者へのインタビューや実地調査など一次情報にあたる行動を積極的に評価に反映する仕組みの構築が有効です。

禁止か許可かを超えて|プロセス評価への転換と批判的検証能力の育成

生成AIが学習に及ぼすリスクを踏まえたとき、教育機関がとるべき姿勢は「全面禁止」でも「無制限の許可」でもありません。問題の本質はAIという技術そのものではなく、それを無指導かつ結果偏重で利用する形態にあります。大学教育に求められるのは、AIの利用を前提としたうえで「思考の補助としてどう使うか」というプロセスを重視する方向へのシフトです。

具体的な取り組みとしては、AIとの対話過程を記録するポートフォリオの作成、AIの出力を批判的に評価するチェックリストの活用、思考プロセスの変化を自己分析させる課題設計などが有効とされています。また、AIの進化速度は非常に速く、今日できなかったことが明日にはできるようになる可能性があります。そのため、特定のAIの機能に焦点を当てたルールづくりではなく、「情報を検証する力」「根拠に基づいて判断する力」「自ら問いを立てる力」といった普遍的な知的基盤を育成する教育設計が求められます。生成AIとの「賢明な共存」とは、AIが得意な情報処理は活用しつつ、人間にしかできない深い思考と創造性を守り育てるバランスを見つけることに他なりません。

#長岡造形大学 #生成AI #横田秀珠 #生成AIセミナー #生成AIコンサルタント #生成AI講座 #生成AI講習 #生成AI講演 #生成AI講師 #生成AI研修 #生成AI勉強会 #生成AI講習会